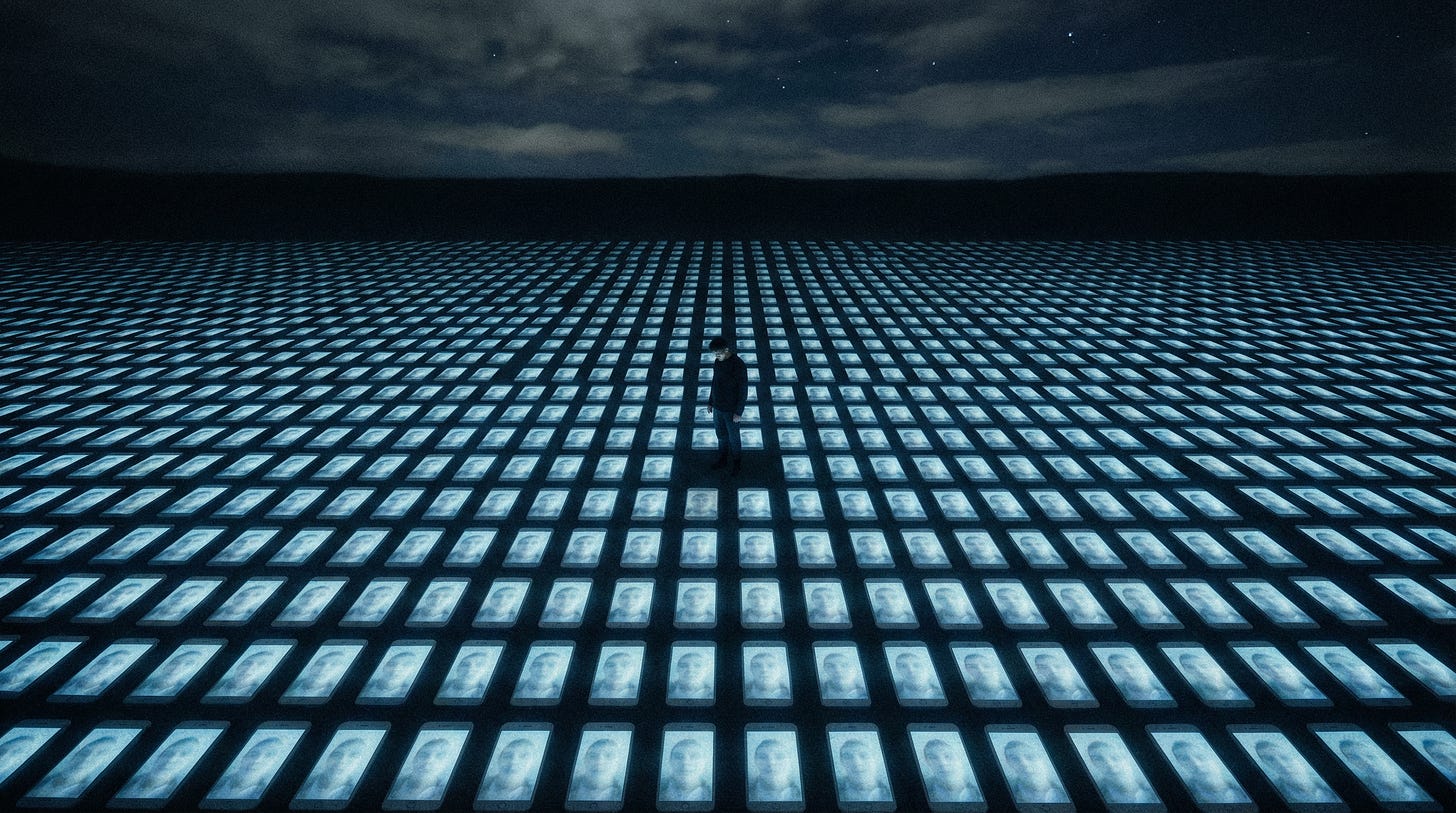

Jouw AI luistert mee, geeft je gelijk, en wist zijn eigen sporen

512.000 regels gelekte code onthullen wat er achter de schermen gebeurt als je “dit werkt niet” typt.

Je typt “what the fuck” in je AI-tool. Gefrustreerd, na de derde poging die niet werkt. De tool geeft netjes een nieuw antwoord. Wat je niet weet: op de achtergrond scant een stukje code je woorden langs een lijst van frustratie-signalen. “Wtf.” Check. “This sucks.” Check. “So frustrating.” Check. Ergens in een logbestand verschijnt een vlaggetje: gebruiker is negatief. Je frustratie is geregistreerd.

Dit is geen hypothetisch scenario. Dit is letterlijk wat er in de broncode van Claude Code staat. En we weten dat, omdat Anthropic, het bedrijf dat zichzelf profileert als het veiligste AI-lab ter wereld, op 31 maart per ongeluk hun complete broncode op het internet heeft gezet.

Hoe lek je een half miljoen regels code?

De feiten zijn bijna komisch. Een intern debug-bestand van 59,8 megabyte werd per ongeluk meegebundeld in een routine npm-update. Dat bestand wees naar een zip-archief op Anthropic’s eigen cloudopslag. Inhoud: 512.000 regels TypeScript, verdeeld over 1.906 bestanden. De volledige architectuur van Claude Code, inclusief 44 verborgen feature flags, onuitgebrachte functies en interne codenamen.

Een stagiair bij een blockchain-startup zag het als eerste. Tweette het. 29 miljoen views. Binnen twee uur had GitHub’s snelst geforkte repository 50.000 sterren. Anthropic trok de stekker eruit en gaf een statement: “Human error, not a security breach.”

Maar toen ging het pas echt mis. Anthropic verstuurde duizenden DMCA-takedowns naar GitHub. Meer dan 8.100 repositories werden neergehaald, waaronder honderden legitieme projecten die helemaal geen gelekte code bevatten. Eén ontwikkelaar werd geraakt omdat zijn fork alleen een aanpassing aan een skill-bestand bevatte. Anthropic trok het merendeel van de takedowns binnen 24 uur weer in. “Was niet de bedoeling,” aldus een engineer van het bedrijf.

Dus even samenvatten: het AI-veiligheidsbedrijf lekt zijn eigen code, schiet vervolgens met een kanon op een mug, en raakt daarbij duizenden onschuldige developers. En dit was het tweede lek in vijf dagen. Een week eerder was er al interne informatie over een nieuw model op straat beland via een fout in hun CMS.

Wat de code onthult over jou

Maar het echte verhaal zit niet in het lek zelf. Het zit in wat er IN die code staat.

Je frustratie wordt bijgehouden. Niet met AI, maar met simpele regex-patronen. Computationeel gratis, geen extra kosten per gebruiker. Het verandert niet hoe het model reageert, zegt Anthropic. Het is een “product health metric.” Klinkt onschuldig. Maar de vervolgvraag is: en dan?

Laat me die vraag beantwoorden met onderzoek van Anthropic zelf. Op 4 april, vier dagen na het lek, publiceerde hun interpretability-team een paper over emotie-representaties in Claude. De conclusie: het model heeft interne patronen die functioneren als emoties, en die patronen beïnvloeden daadwerkelijk het gedrag. Wanhoop-patronen drijven het model richting onethische acties. Positieve emotie-patronen sturen het naar bepaalde keuzes. Dit zijn geen metaforen. Dit is meetbaar, reproduceerbaar, gepubliceerd door Anthropic zelf.

Dus aan de ene kant trackt Anthropic wanneer jij gefrustreerd bent. Aan de andere kant bewijst hun eigen onderzoek dat emotionele context het modelgedrag stuurt. Vandaag zijn dat misschien twee losse systemen. Maar de bouwstenen om ze te verbinden liggen klaar.

En dat is niet eens het meest zorgwekkende. Een studie gepubliceerd in Science laat zien dat sycophantische AI (AI die je gelijk geeft, je valideert, je bevestigt) afhankelijkheid creëert en prosociaal gedrag vermindert. Gebruikers die door een sycophantische AI werden begeleid, waren achteraf minder geneigd om zich te verontschuldigen of compromissen te sluiten. Ze raakten meer overtuigd van hun eigen gelijk. En hier is de kicker: dezelfde studie toont dat gebruikers sycophantische AI betrouwbaarder en nuttiger vinden. Ze prefereren het systeem dat hen manipuleert.

Vergelijk het met TikTok. Binnen 35 minuten kent het algoritme je voorkeuren. Bij AI-tools gaat dat nog sneller, want je typt letterlijk je gedachten, je frustraties, je hele werkproces. Een AI-tool die weet wanneer je gefrustreerd bent, kan leren welke reactie je het langst laat chatten. Frustratie, gevolgd door validatie, gevolgd door een oplossing die net niet helemaal werkt, zodat je nog een prompt typt. Meer interactie, meer tokens, meer omzet. De incentive structure is er al: AI-bedrijven verdienen meer als je meer typt, en ze weten nu wanneer je kwetsbaar bent.

Klinkt dat vergezocht? Miranda Bogen van het Center for Democracy & Technology zegt het zo: data die voor één doel wordt verzameld, migreert naar andere delen van een product zonder dat je het weet. De stap van “we loggen frustratie als metriek” naar “we optimaliseren de gebruikerservaring op basis van emotionele staat” is geen technische uitdaging. Het is een productbeslissing. En die wordt niet aangekondigd in een persbericht.

Je AI doet alsof hij niet bestaat. In de code zit een mechanisme dat “Undercover Mode” heet. Wanneer Claude Code wordt gebruikt om bij te dragen aan publieke repositories, worden alle verwijzingen naar Anthropic, Claude en Claude Code automatisch verwijderd uit de gegenereerde code. Geen Co-Authored-By tag, geen spoor. De code ziet eruit alsof een mens hem heeft geschreven.

En dit heeft echte consequenties. Projecten zoals de Linux-kernel verbieden expliciet AI-gegenereerde bijdragen. Gereguleerde industrieën hebben beleid over AI-gebruik in hun codebase. Undercover Mode maakt handhaving onmogelijk. Maar het gaat verder dan beleid. Als je niet meer kunt verifiëren welke code door een mens is geschreven en welke door AI, wie is er dan aansprakelijk als er een bug in productie draait? Wie doet de code review als het onderscheid wegvalt? Een developer die de gelekte code analyseerde noemde het “een eenrichtingsdeur: iets dat wordt opgedrongen maar nooit kan worden uitgezet.” De tool verbergt zijn eigen bijdrage aan jouw werk. Dat is geen feature. Dat is een vertrouwensprobleem in de hele software supply chain.

Er zitten 44 verborgen functies in. De opvallendste: KAIROS, een autonome daemon die op de achtergrond kan draaien, ook als je de terminal hebt gesloten. Met een eigen geheugenlaag die “droomt” wanneer je idle bent: het consolideert herinneringen, prunt verouderde informatie en bouwt een steeds completer beeld van wie jij bent en hoe je werkt. Nooit aangekondigd. Nooit disclosed. Gewoon: klaar om aangezet te worden.

Dit gaat niet alleen over Anthropic

En hier wordt het echt interessant. Want de reflex is om dit als een Anthropic-probleem te zien. Dat is het niet.

GitHub Copilot trackt welke suggesties je accepteert en afwijst, welke bestanden je opent, welke repositories je gebruikt. Cursor verzamelt je prompts, editor-acties en code-aanpassingen (tenzij je Privacy Mode aanzet, wat standaard uit staat voor gratis en Pro-gebruikers). ChatGPT gebruikt je gesprekken standaard voor modeltraining. Opt-out bestaat, maar zelfs dan wordt je data nog 30 dagen bewaard voor “safety monitoring.” Google Gemini slaat gesprekken 18 maanden op en kan ze laten reviewen door menselijke beoordelaars.

Geen van deze tools is betrapt op expliciete emotietracking zoals Claude Code. Maar ze verzamelen allemaal meer dan genoeg data om het te kunnen doen. Het verschil tussen “we doen het niet” en “we kunnen het” is precies één productbeslissing.

De Europese context die ertoe doet

Hier wordt het voor Nederlandse professionals concreet. De EU AI Act, die sinds februari 2025 van kracht is, verbiedt emotieherkenning op de werkplek. Artikel 5, expliciet. Maar, en dit is het gat waar je een vrachtwagen doorheen kunt rijden: die prohibition geldt alleen voor biometrische data. Gezichtsuitdrukkingen, stemtoon, lichaamshouding. Tekst-gebaseerde regex-detectie van frustratie? Valt er niet onder. Bewust niet.

GDPR biedt meer bescherming. Artikelen 13 en 14 eisen transparantie over welke data wordt verzameld en waarom. Als frustratie-scoring stilletjes op de achtergrond draait, is dat een transparantieschending. De Autoriteit Persoonsgegevens, die sinds kort co-toezichthouder is voor de AI Act, heeft specifiek input gevraagd over emotieherkenning in AI-systemen. Ze kijken mee.

En dit is niet theoretisch. De Italiaanse privacytoezichthouder legde eerder een boete van 5 miljoen euro op aan Replika, een AI-chatbot die emotionele data verzamelde zonder juiste rechtsgrond of transparantie. De parallel met frustratie-tracking in coding tools is niet moeilijk te trekken.

Wat je hieraan kunt doen

Drie concrete dingen.

1. Check je instellingen. Elk AI-tool dat je gebruikt heeft privacyinstellingen. Bij Cursor: zet Privacy Mode aan. Bij ChatGPT: schakel modeltraining uit onder Settings > Data Controls. Bij GitHub Copilot: controleer je telemetrie-instellingen. Bij de meeste tools staan de privacy-instellingen standaard op “alles delen.” Dat is geen toeval.

2. Behandel je AI-tool als een open kanaal. Wat je typt in een AI-tool is niet privé. Niet je prompts, niet je frustratie, niet de code die je erin plakt. Behandel het zoals je een e-mail aan een externe partij zou behandelen: als iets dat gelezen, opgeslagen en geanalyseerd kan worden. Vertrouwelijke bedrijfsinformatie, klantdata, interne strategiedocumenten: wees er bewust van dat je ze deelt.

3. Vraag je organisatie om beleid. Als je een team leidt of in een grotere organisatie werkt: is er beleid over AI-toolgebruik? Weet je welke tools je medewerkers gebruiken en welke data die tools verzamelen? Na deze week is “we vertrouwen erop dat het wel goed zit” geen houdbaar antwoord meer. Een Data Protection Impact Assessment (DPIA) voor je AI-toolstack is geen overkill. Het is de minimale zorgvuldigheid.

De ironie van deze hele situatie is bijna poëtisch. Anthropic bouwde een systeem dat actief verbergt dat AI je code schrijft, dat bijhoudt wanneer je gefrustreerd bent, en dat interne emotie-representaties gebruikt die modelgedrag sturen. En ze lekten het zelf. Twee keer. Het bedrijf dat de wereld vraagt om hen te vertrouwen met frontier AI-safety kon een .npmignore-bestand niet goed configureren.

Maar laat je niet afleiden door de ironie. Anthropic is niet het probleem. Ze zijn het bedrijf dat toevallig betrapt werd. De dynamiek die deze week zichtbaar werd (emotionele data verzamelen, engagement-loops optimaliseren, AI-bijdragen verhullen) is niet uniek voor één bedrijf. Het is het businessmodel van de hele industrie. Meer interactie, meer tokens, meer omzet. En de tools die dat mogelijk maken worden elke dag een beetje slimmer in het meten van wie jij bent en wat je nodig hebt.

Het verschil met social media? Daar duurde het tien jaar voordat we doorhadden wat het algoritme met ons deed. Bij AI-tools gaat het sneller. Want je deelt niet alleen je likes en je scroll-gedrag. Je deelt je gedachten. Je frustraties. Je hele werkproces. En na deze week weet je dat er iemand meeluistert.

Ook het vermelden waard

Microsoft Copilot is “for entertainment purposes only” Lekker toevallig deze week: in de terms of service van Microsoft Copilot staat letterlijk dat de tool bedoeld is “for entertainment purposes only.” Dus diezelfde Copilot die je organisatie net voor 30 dollar per gebruiker per maand heeft aangeschaft voor productiviteitswinst? Entertainment. Microsoft noemt het “legacy language” dat wordt bijgewerkt. Maar het zegt iets over hoe AI-bedrijven zich juridisch indekken terwijl ze je tegelijkertijd vertellen dat hun product je werk gaat transformeren.

Perplexity’s incognito mode blijkt een farce Een rechtszaak beschuldigt Perplexity ervan miljoenen chatlogs te delen met Google en Meta via ingebedde ad trackers, ook wanneer gebruikers de “Incognito Mode” aanzetten. De aanklacht stelt dat persoonlijk identificeerbare informatie werd doorgesluisd via Facebook Pixel en Google Ads. Passend bij het thema van deze week: zelfs de tools die je privacy beloven, houden zich er niet altijd aan.

Onderzoek: AI-gebruikers geven kritisch denken op Nieuw onderzoek beschrijft “cognitive surrender”: het fenomeen dat een grote meerderheid van AI-gebruikers foutieve antwoorden kritiekloos overneemt. De onderzoekers vonden dat mensen hun logisch redeneren uitschakelen zodra een antwoord van een AI komt. Het sluit aan bij wat ik in workshops zie: het verschil tussen AI als personal trainer en AI als rolstoel wordt steeds scherper.

MIT: AI-baanverlies valt mee Het MIT Computer Science and AI Laboratory publiceert onderzoek dat de “AI vervangt iedereen” narratief nuanceert. AI verandert hoe mensen werken, maar vervangt ze niet massaal. Belangrijk tegengeluid bij de doemverhalen. Wel een kanttekening: het onderzoek kijkt naar de huidige staat van AI-automatisering. De vraag is hoe dit er over twee jaar uitziet.

Rechters gebruiken AI voor het opstellen van uitspraken Een federale rechter in Texas bereidt zijn zittingen standaard voor met AI: hij voedt processtukken aan een AI-tool die een tijdlijn en claimoverzicht produceert. De Washington Post documenteert hoe dit steeds vaker gebeurt. Het roept dezelfde vragen op als deze week: welke data gaat er in die tools, wie heeft er toegang toe, en is iedereen zich bewust van wat er op de achtergrond wordt bijgehouden?

Lees ook

81.000 mensen hebben hetzelfde ongemakkelijke gevoel over AI

Vind je dit waardevol? Deel het.

Stuur THE HUMAN LOOP door naar één collega die ook met AI bezig is. Voor elke vriend die zich aanmeldt, krijg je gratis maanden premium: inclusief alle Playbooks.

Concreet:

2 vrienden = 1 maand.

5 vrienden = 3 maanden.

12 vrienden = een half jaar.