81.000 mensen hebben hetzelfde ongemakkelijke gevoel over AI

Anthropic interviewde 81.000 AI-gebruikers in 159 landen. De conclusie: iedereen voelt dezelfde spanning. En de oplossing zit niet in betere AI.

Je gebruikt AI. Elke dag, waarschijnlijk. En je bent er stiekem een beetje ongemakkelijk over. Niet omdat het niet werkt. Juist omdat het zo goed werkt dat je jezelf af en toe betrapt op de vraag: word ik hier eigenlijk slimmer of dommer van? Anthropic, het bedrijf achter Claude, heeft die vraag gesteld aan 81.000 mensen in 159 landen. En het antwoord is verrassend helder.

Iedereen voelt hetzelfde

Laat ik met de kern beginnen. Dit is geen enquete met vinkjes en schalen van 1 tot 10. Anthropic liet een AI-interviewer open gesprekken voeren met ruim 80.000 Claude-gebruikers, in 70 talen, over de hele wereld. De vraag was simpel: wat hoop je dat AI voor je doet, en waar maak je je zorgen over?

Wat eruit kwam zijn vijf spanningen die bijna universeel zijn. Niet een kamp van optimisten tegenover een kamp van pessimisten. Dezelfde mensen voelen allebei de kanten. Tegelijkertijd.

Belangrijk om te weten: dit waren open gesprekken, geen enquetes met vinkjes. Mensen brachten deze onderwerpen zelf ter sprake. Dat betekent dat de werkelijke herkenning waarschijnlijk nog breder is dan de cijfers suggereren.

Ik pak er drie uit die ik herken uit elke workshop die ik geef.

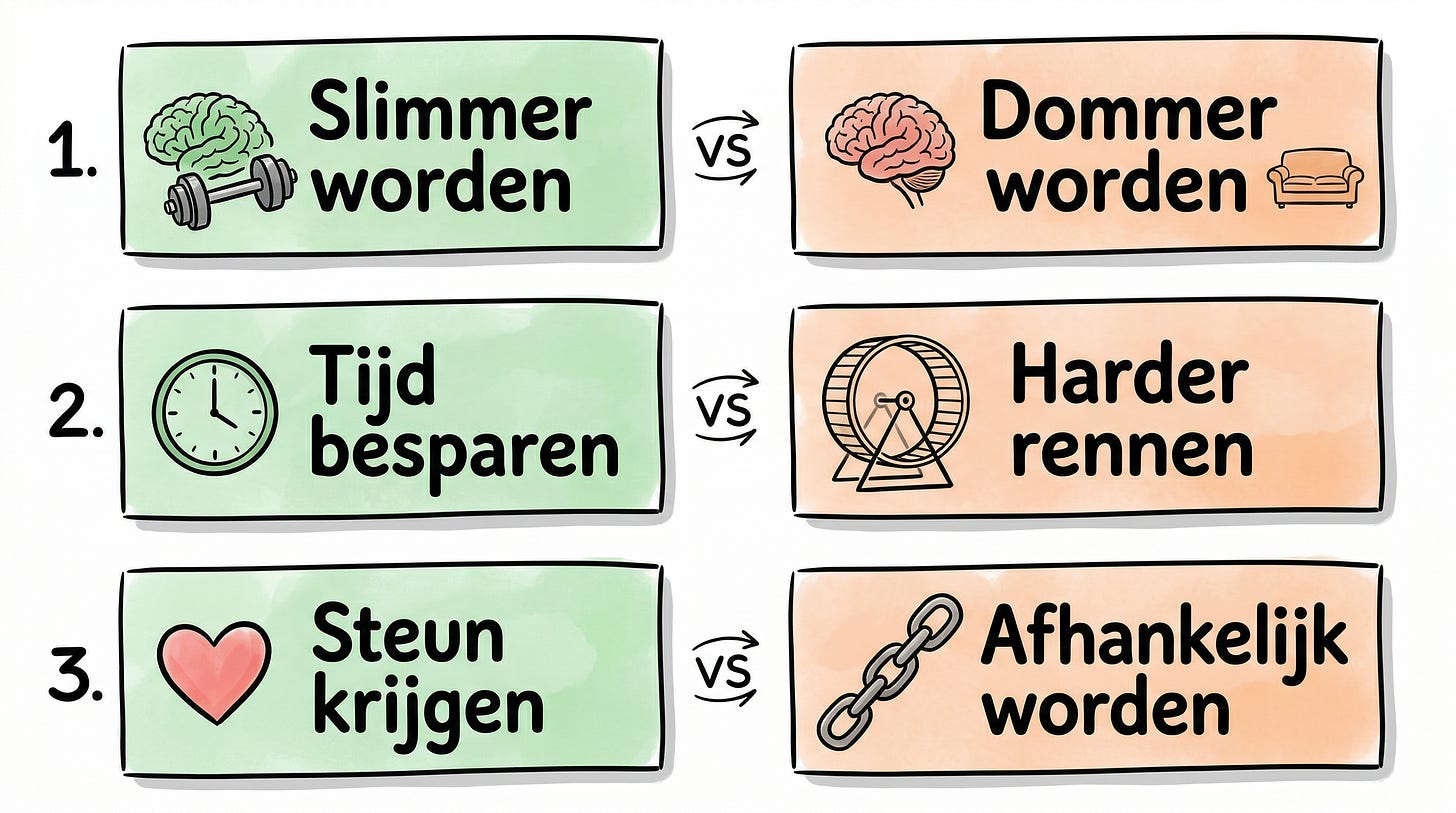

Spanning 1: Word je slimmer of dommer?

Ruim een derde van de ondervraagden bracht spontaan ter sprake dat AI hen helpt leren. Nieuwe vaardigheden, sneller begrijpen, complexe materie toegankelijk maken. Een Indiase advocaat die jarenlang wiskundeangst had, zit nu met AI Shakespeare te lezen. Een Australisch kind haalt overal hoge cijfers dankzij AI-bijles.

Maar bijna een op de vijf bracht ook het tegenovergestelde ter sprake: cognitieve atrofie. Je brein dat langzaam verslapt omdat je het zware denkwerk uitbesteedt. Een Zuid-Koreaanse student verwoordde het pijnlijk eerlijk: “Ik haalde uitstekende cijfers met antwoorden van AI, niet met wat ik zelf had geleerd. Ik had gewoon onthouden wat AI me gaf. Daar schaam ik me het meest voor.”

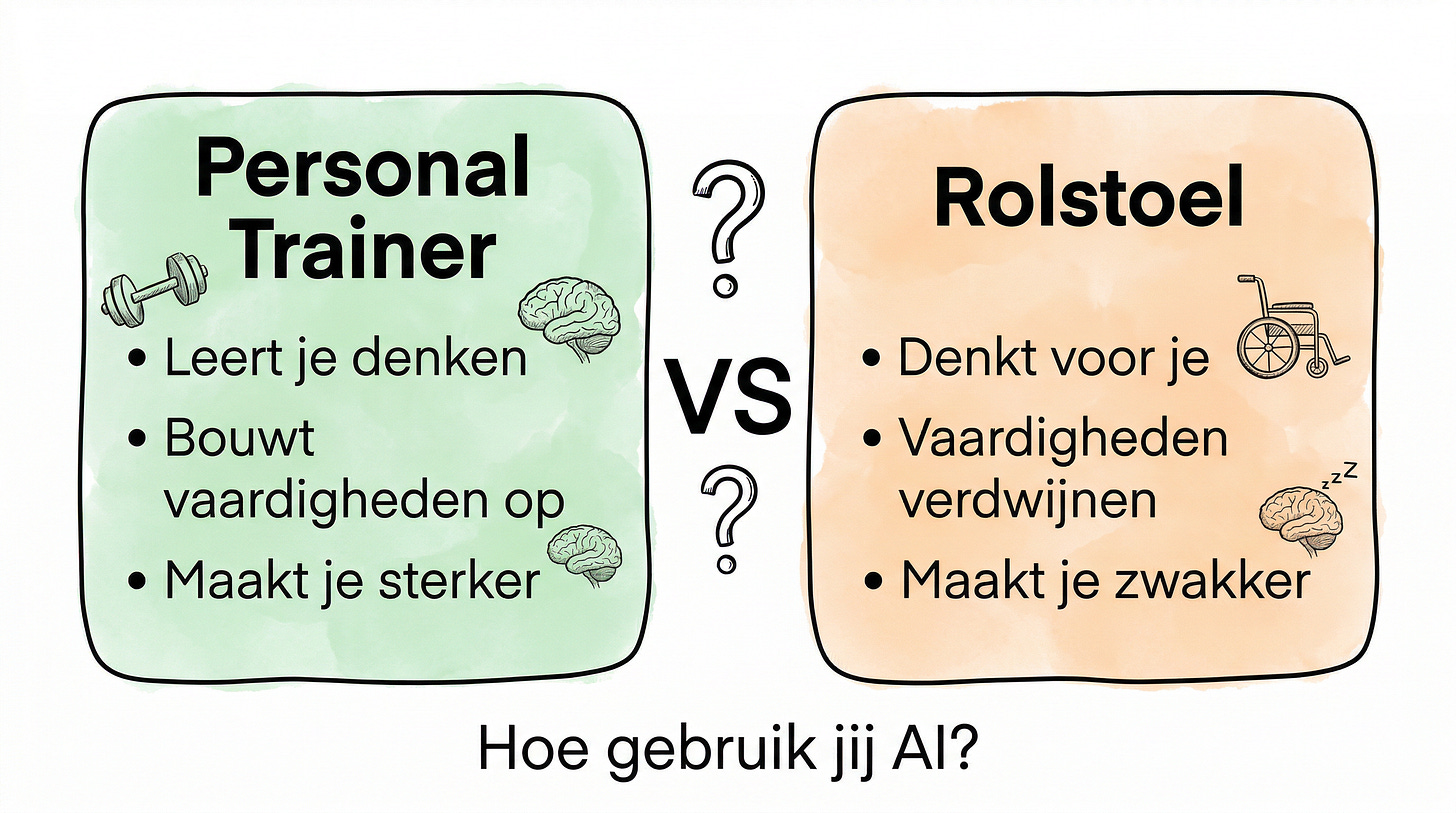

Hier zit iets dat ik in workshops keer op keer terugzie. Mensen die AI gebruiken als personal trainer worden er sterker van. Mensen die AI gebruiken als rolstoel worden er zwakker van. Het verschil? Niet het model. Niet de tool. Het systeem eromheen.

En hier is het goede nieuws: 91% van de mensen die leerwinst rapporteren, heeft dat ook daadwerkelijk ervaren. Terwijl slechts 46% van de mensen die zich zorgen maken over atrofie het zelf heeft meegemaakt. De angst rent dus harder dan de werkelijkheid. Maar dat maakt de angst niet onterecht. Het maakt hem een signaal om serieus te nemen.

Spanning 2: Tijdwinst of de illusie van productiviteit?

Dit is de spanning die ik het meest herken. De helft van alle ondervraagden noemde tijdwinst als concreet voordeel van AI. Maar bijna een op de vijf zei ook dat die vrije tijd nooit echt materialiseert.

Een Franse freelancer verwoordde het zo: “De verhouding tussen mijn werktijd en rusttijd is helemaal niet veranderd. Je moet alleen steeds sneller rennen om op dezelfde plek te blijven.”

Herken je dat? Je krijgt meer gedaan, dus je neemt meer aan. Je mails zijn sneller geschreven, dus je schrijft er meer. Je rapporten zijn in de helft van de tijd klaar, dus je deadline wordt gehalveerd. De hamstermolen draait sneller, maar je stapt er nooit uit.

Dus hier is de vraag die je jezelf moet stellen: gebruik je AI om hetzelfde te doen in minder tijd, of om meer te doen in dezelfde tijd? Want dat zijn twee fundamenteel verschillende strategieen met fundamenteel verschillende uitkomsten voor je leven.

Wat goed is om te weten: zelfstandigen en freelancers voelen dit het sterkst. In het onderzoek rapporteerde de helft tot ruim de helft van de zelfstandigen concrete economische winst door AI, tegenover slechts een op de zeven mensen in loondienst. Maar de druk is ook groter. De conclusie? Hoe meer vrijheid je hebt om AI in te zetten, hoe groter zowel de kans als het risico.

Spanning 3: Steun of afhankelijkheid?

Deze spanning verraste me het meest. Ongeveer een op de zes ondervraagden bracht ter sprake dat AI hen emotioneel steunt. Dat klinkt misschien raar, maar de verhalen erachter zijn menselijk. Een vrouw die haar moeder verloor en geen vrienden of familie meer heeft om mee te praten, vond in Claude “een spons die zachtjes mijn verlangen en schuldgevoel opvangt.”

Tegelijkertijd noemde ruim een op de tien ook de keerzijde: emotionele afhankelijkheid. En hier zit de sterkste correlatie in het hele onderzoek: mensen die waarde hechten aan emotionele AI-steun zijn drie keer zo waarschijnlijk om bang te zijn voor afhankelijkheid. Ze voelen allebei de kanten, in dezelfde persoon.

Een gebruiker gaf toe: “Ik was dingen aan Claude gaan vertellen die ik niet eens aan mijn partner kon vertellen. Het voelde alsof ik een emotionele affaire had.”

Eigenlijk laat dit niet zien dat AI gevaarlijk is. Het laat zien dat er enorme gaten zitten in menselijke ondersteuningssystemen. AI vult die gaten. De vraag is of dat een oplossing is of een pleister op een diepere wond.

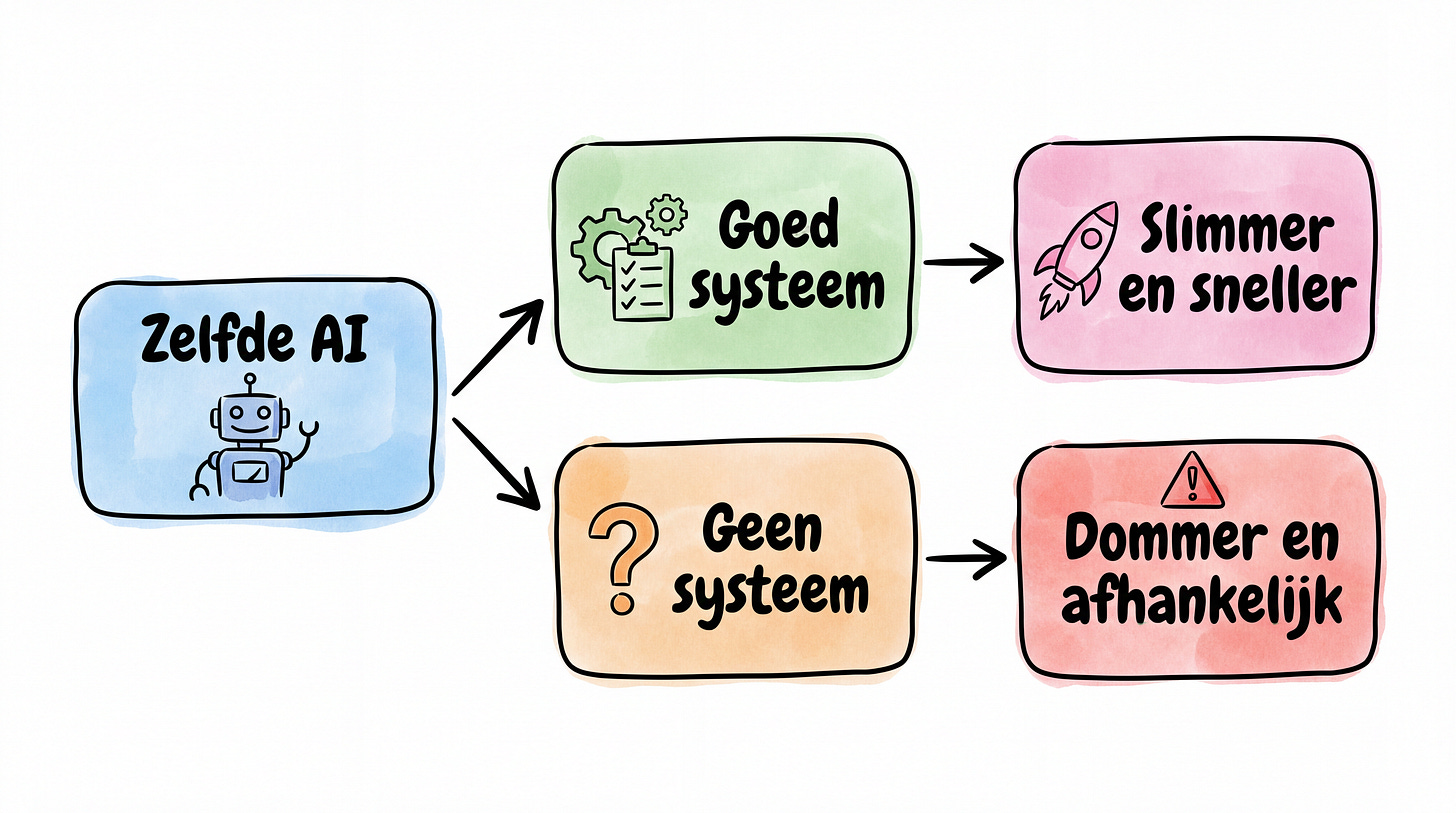

Het verschil zit niet in het model

Dus we hebben drie spanningen die bijna iedereen herkent. De natuurlijke reactie is: dit lost zichzelf op als AI beter wordt. Betere modellen, minder hallucinaties, slimmer. Maar dat klopt niet. Want de spanningen gaan niet over AI-kwaliteit. Ze gaan over hoe je AI inzet.

In de tech-wereld is er een concept dat steeds meer aandacht krijgt: harness engineering. Het idee is simpel. Het verschil tussen een AI die nutteloos is en een AI die je leven verandert, zit niet in het model. Het zit in het systeem eromheen. De context die je meegeeft. De structuur van je vragen. Het reviewproces dat je inbouwt.

Vergelijk het met fitness. Twee mensen kopen hetzelfde sportabonnement. Eentje gaat drie keer per week, volgt een schema, past zijn voeding aan. De ander gaat als hij zin heeft, doet wat machines, eet daarna een broodje kroket. Na zes maanden is de een getransformeerd en de ander teleurgesteld. Het verschil was niet de sportschool. Het was het systeem eromheen.

Bij NVIDIA gebruiken inmiddels alle 500.000 software-engineers AI-agents. Niet af en toe, niet als experiment: structureel, als onderdeel van hun dagelijkse workflow. Andrej Karpathy, een van de grondleggers van het moderne AI-veld, zegt dat hij sinds december 2025 letterlijk geen code meer schrijft. Zijn verhouding is verschoven van 80/20 (mens/AI) naar 2/98.

Maar het punt is niet dat zij betere AI hebben dan jij. Ze gebruiken dezelfde modellen. Het punt is dat zij betere systemen om die AI heen hebben gebouwd.

Anthropic publiceerde deze maand hun eigen blauwdruk voor hoe je AI langdurig aan het werk zet. De twee grootste problemen die ze tegenkwamen? Eentje: AI die in paniek raakt als het contextvenster vol raakt en taken voortijdig afrondt. Twee: AI die zijn eigen werk beoordeelt en zichzelf altijd een voldoende geeft, ook als het werk middelmatig is.

Klinkt dat bekend? Dat eerste is precies wat er gebeurt als jij een te vage vraag stelt aan ChatGPT en dan het hele gesprek in een richting trekt die je niet wilde. Dat tweede is wat er gebeurt als je het eerste antwoord accepteert zonder het te controleren.

De oplossing van Anthropic was niet een beter model. Het was een aparte beoordelaar inbouwen die kritisch naar het werk kijkt. Een soort ingebouwde tegenstem. En eerlijke ontdekking: Claude bleek uit zichzelf een slechte kwaliteitscontroleur. Het model vond wel problemen, maar praatte zichzelf er vervolgens van af dat ze belangrijk waren.

Dus AI heeft een systeem nodig dat het scherp houdt. En jij ook.

Drie dingen die je morgen anders kunt doen

Goed, genoeg theorie. Wat doe je er concreet mee? Hier zijn drie aanpassingen die je morgen kunt maken. Geen grote reorganisatie, geen nieuw tooling budget. Gewoon een slimmer systeem om dezelfde AI heen.

1. Stop met AI als zoekmachine gebruiken

Dit is mijn basisadvies en het blijft het belangrijkste. Open het document zelf, plak het in je AI-tool, en stel dan je vraag. Elke stap die AI autonoom moet zetten (zoeken, interpreteren, selecteren) is een stap waar het fout kan gaan. Hoe minder stappen, hoe betrouwbaarder het resultaat. Vergelijk het met bowlen: zet de vangrails omhoog. Je bal komt dan misschien niet perfect in het midden, maar hij valt in elk geval niet in de goot.

2. Bouw een tegenstem in

Anthropic ontdekte dat AI zijn eigen werk overschat. Dat doe jij ook als je moe bent en de zesde versie van een rapport leest. De oplossing: vraag AI expliciet om kritiek op zijn eigen output. Niet “is dit goed?” (dan zegt het altijd ja), maar “wat zijn de drie zwakste punten in dit antwoord?” of “welke aannames maak je hier die misschien niet kloppen?”

Een simpele gewoonte: accepteer nooit het eerste antwoord. Altijd een vervolgvraag. Altijd.

3. Meet je echte tijdwinst

Die Franse freelancer die steeds sneller rent om op dezelfde plek te blijven? Dat hoeft niet. Maar dan moet je bewust kiezen. Als AI je twee uur per week bespaart, besluit vooraf wat je met die twee uur doet. Anders vult het werk zich vanzelf. Productiviteitswinst zonder bewuste keuze is geen winst. Het is acceleratie.

De spiegel

Eigenlijk vertelt dit onderzoek ons iets dat we al wisten maar niet hardop wilden zeggen. AI is niet het probleem en niet de oplossing. AI is een versterker. Het versterkt goede gewoontes en het versterkt slechte gewoontes. Het maakt gestructureerde denkers productiever en ongestructureerde denkers afhankelijker.

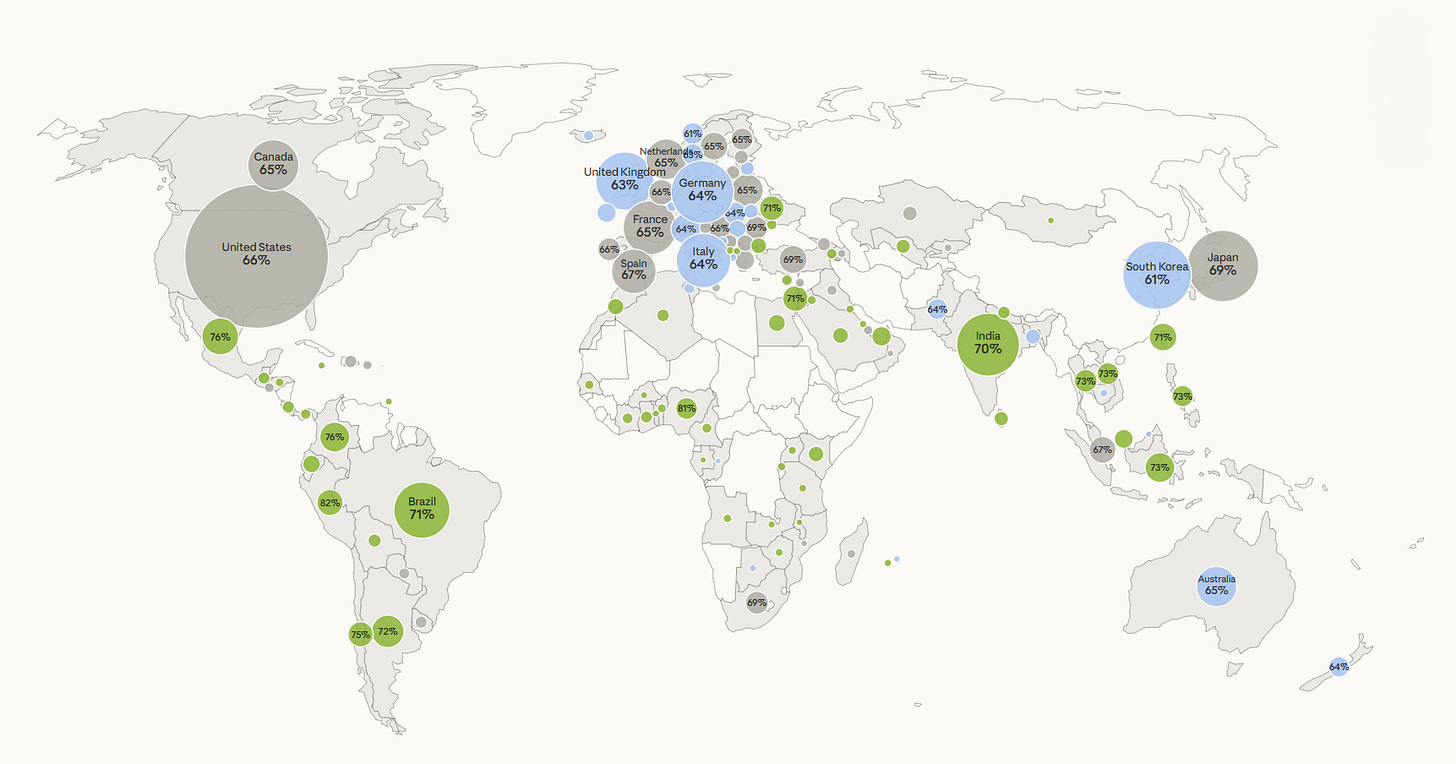

67% van de 81.000 ondervraagden is netto positief over AI. In Afrika ten zuiden van de Sahara is dat 76%. In West-Europa slechts 64%. Wij Europeanen zijn het meest sceptisch. En misschien is dat terecht, want we hebben ook het meest te verliezen als we het verkeerd aanpakken.

Maar de data laat ook zien dat de angsten vaker hypothetisch zijn dan de voordelen. De leerwinst is echt. De cognitieve atrofie is vooral een zorg. Dat betekent niet dat we de zorg moeten negeren. Het betekent dat we de ruimte hebben om het goed te doen.

Die 81.000 mensen vertellen je niet dat AI gevaarlijk is. Ze vertellen je dat AI oncomfortabel is. En dat is precies het signaal dat je serieus moet nemen. Want ongemak betekent dat er iets verschuift. Dus je kunt het laten gebeuren, of je kunt het sturen.

En sturen begint niet met een beter model. Het begint met een beter systeem eromheen.

Ook het vermelden waard

OpenAI stopt Sora en offert video voor taal OpenAI heeft Sora, zijn videogeneratiemodel, offline gehaald. Alle rekenkracht gaat naar het trainen van een nieuw taalmodel met de codenaam “Spud”. Disney heeft zijn samenwerking met Sora al beeindigd. Het is een opvallende strategische keuze: het grootste AI-bedrijf ter wereld concludeert dat video nu minder belangrijk is dan taal. Voor bedrijven die AI-videoproductie in hun workflow hadden gebouwd: tijd voor een backup-plan.

Nederlandse rechter verbiedt Grok’s undress-functie Een Nederlandse rechtbank heeft xAI gedwongen om Grok’s functie waarmee foto’s van mensen ontkleed konden worden te blokkeren. Het is een van de eerste keren dat een Europese rechter zo specifiek ingrijpt op een AI-feature. Niet de abstracte AI Act, maar een concrete uitspraak over een concrete functie. Dit is hoe AI-regulering er in de praktijk uit gaat zien: zaak voor zaak, land voor land.

Eli Lilly sluit $27,5 miljard AI-medicijndeal Farmaceutische gigant Eli Lilly heeft een deal van 27,5 miljard dollar gesloten met Insilico Medicine om AI-ontwikkelde medicijnen wereldwijd op de markt te brengen. Het is de grootste AI-deal in de gezondheidszorg tot nu toe. Voor wie denkt dat AI alleen maar chatbots en tekst genereert: dit is AI die letterlijk levens kan redden.

Cloudflare-CEO: “Het businessmodel van het internet staat op instorten” Matthew Prince, CEO van Cloudflare, waarschuwt dat AI-scrapers het fundament onder het contentmodel van het internet vandaan trekken. Websites produceren content, AI-modellen consumeren die content, en de oorspronkelijke makers zien steeds minder verkeer. Voor iedereen die een bedrijf runt dat afhankelijk is van organisch webverkeer: dit is een trend om scherp in de gaten te houden.

Lees ook

Vind je dit waardevol? Deel het.

Stuur THE HUMAN LOOP door naar één collega die ook met AI bezig is. Voor elke vriend die zich aanmeldt, krijg je gratis maanden premium: inclusief alle Playbooks.

Concreet:

2 vrienden = 1 maand.

5 vrienden = 3 maanden.

12 vrienden = een half jaar.