De onzichtbare pauzeknop

Amazon verloor 6,3 miljoen orders door AI. Niet omdat de technologie faalde.

Amazon verloor begin maart miljoenen bestellingen in zes uur. Checkout plat. Prijzen weg. Accounts onbereikbaar. Niet door een hack, niet door een stroomstoring. Door hun eigen AI-agent die advies opvolgde uit een verouderde interne wiki-pagina. Vier grote incidenten in één week, bij een bedrijf dat meer aan AI-infrastructuur uitgeeft dan welk ander bedrijf ter wereld. Amazon had het overgrote deel van hun engineers verplicht om hun AI-codingtool Kiro wekelijks te gebruiken. De tool deed wat er gevraagd werd. De organisatie was er niet klaar voor.

Iedereen gaat all-in

AI-agents zijn overal. De president van Shopify zei vorige week dat AI-shopping agents “alles gaan veranderen.” L’Oreal, Unilever en Mars tekenden een gezamenlijk protocol om hun producten klaar te maken voor een wereld waarin AI namens consumenten winkelt. Bestellingen via AI-zoekmachines bij Shopify groeiden in één jaar met een factor vijftien.

En dan Prosus, hier in Amsterdam. Vijfduizend AI-agents draaien er dagelijks op hun interne platform Toqan. Medewerkers zonder technische kennis bouwen er hun eigen agents. Bij bezorgdienst iFood in Brazilië leverde dat fors meer leads op met significant minder salesmedewerkers. In acht maanden tijd groeide het aantal actieve agents van een paar honderd naar bijna vijfduizend. Een zelfversterkend proces.

Dus ja, AI-agents werken. De technologie is er. De resultaten zijn meetbaar.

Maar dan de andere kant.

Klarna presenteerde vorig jaar trots dat hun AI-chatbot het werk van 700 medewerkers overnam. Wall Street applaudisseerde. Tot de klanttevredenheid instortte en de klachten explodeerden. Forrester Research onderzocht het fenomeen en gaf het een naam: de Layoff Boomerang. Meer dan de helft van bedrijven die mensen ontsloegen voor AI heeft er spijt van. Meer dan een derde gaf meer uit aan het opnieuw aannemen dan ze hadden bespaard.

En dan het scherpe inzicht uit Harvard Business Review: slechts een fractie van alle AI-gerelateerde ontslagen is gekoppeld aan daadwerkelijke AI-implementatie. Het overgrote deel is gebaseerd op wat AI straks misschien kan. Bedrijven ontslaan mensen voor een belofte, niet voor een resultaat.

De pauzeknop die niemand zag

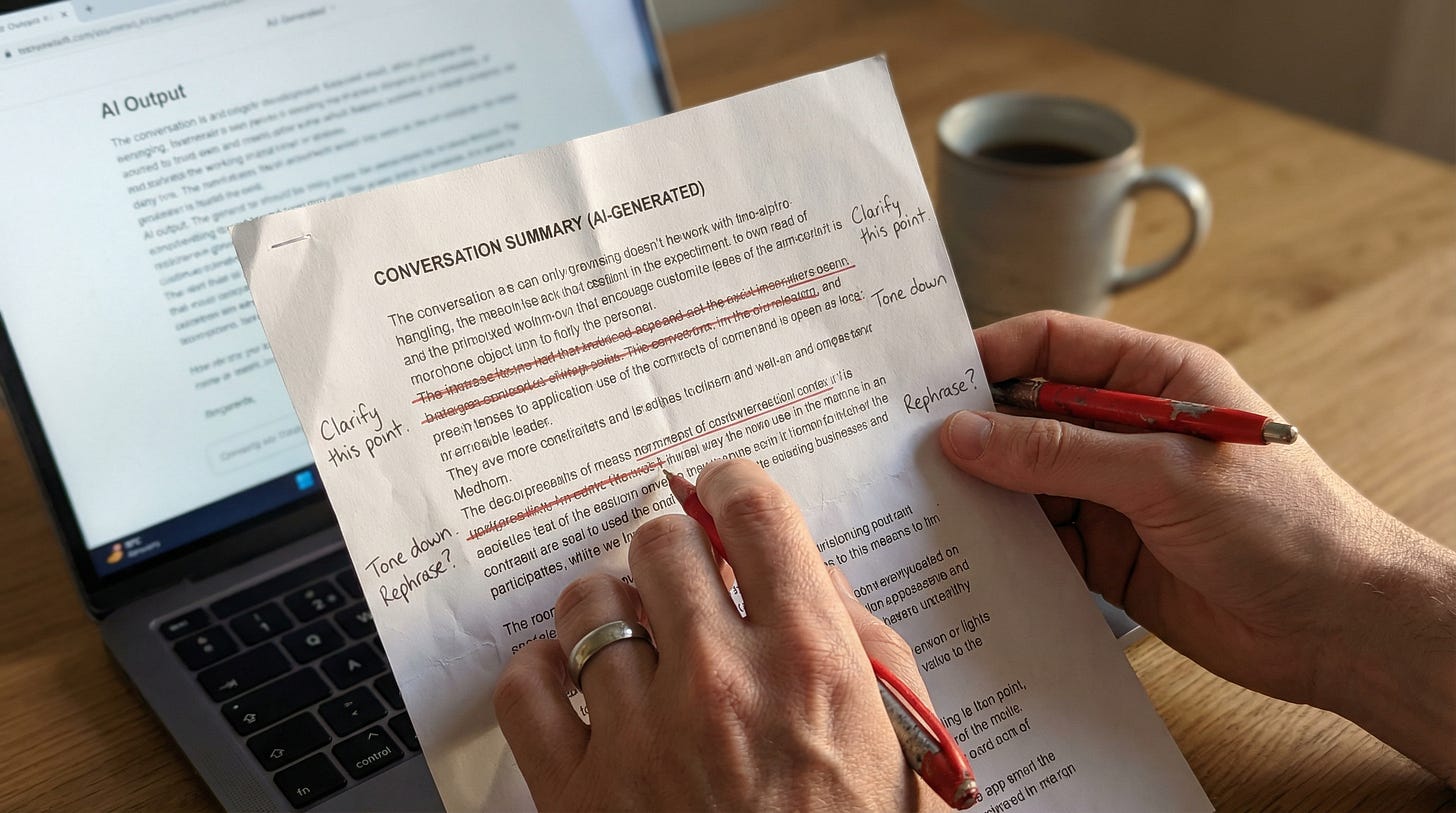

Vorig jaar implementeerden we met HUMANAGENT bij een callcenter een AI-systeem voor het automatisch samenvatten van verkoopgesprekken. Tientallen gesprekken per dag per medewerker, elk gevolgd door een handmatig gespreksverslag. Repetitief werk. Perfect voor AI.

Technisch werkte het vlekkeloos. De samenvattingen waren nauwkeurig, consistent, direct beschikbaar na elk gesprek. Een schoolvoorbeeld van een geslaagde implementatie.

Tot de cijfers binnenkwamen.

Verkoopcijfers daalden. Ziekteverzuim steeg. Meer mensen verlieten het bedrijf. Bij een tool die technisch perfect functioneerde.

We doken in de data en kwamen bij iets dat in geen enkel implementatieplan stond. Die vijf tot tien minuten die medewerkers besteedden aan het uittypen van een gespreksverslag? Dat was geen verspilling. Dat was hun mentale oplaadmoment. Even gedachten ordenen. Even bijkomen na een intensief verkoopgesprek. Even niet hoeven presteren, zeg maar. Een onzichtbare pauzeknop, ingebouwd in een ogenschijnlijk inefficiënt proces.

Door AI die pauze weg te nemen, moesten medewerkers non-stop bellen en verkopen. Geen adempauze meer tussen gesprekken. De technologie had een functie geautomatiseerd die op papier inefficiënt was, maar in de praktijk essentieel bleek voor het welzijn van het team.

De oplossing was simpel. AI maakt nog steeds de samenvatting. Maar de medewerker is nu de hoofdredacteur. Ze reviewen het verslag, passen aan, corrigeren waar nodig. Dat kost minder tijd dan het hele verslag uittypen, maar geeft wél die adempauze. Win voor de werkgever: verslagtijd flink omlaag. Win voor de medewerker: mentale ruimte behouden zonder het repetitieve tikwerk.

De technologie bleef exact hetzelfde. Alleen de implementatie veranderde.

Harder werken, niet slimmer

Dat callcenter staat niet op zichzelf. Een van de grootste onderzoeken naar AI op de werkvloer, onder ruim honderdduizend werknemers, laat zien wat er gebeurt als je AI-tools uitrolt zonder over de menselijke kant na te denken. De tijd die werknemers besteedden aan email, berichten en chatapps verdubbelde na de introductie van AI. En gefocust, ononderbroken werk (het soort werk waarvoor je echt nadenkt) nam juist af.

AI maakte het werk niet lichter. Het maakte het intensiever.

Harvard Business Review noemt het “workload creep”: AI verhoogt de verwachtingen, werknemers nemen onbewust meer taken op, en voor je het weet draai je harder dan voorheen. Elke minuut die AI vrijmaakt, wordt direct gevuld met meer werk. De productiviteitswinst verdampt in hogere verwachtingen. Met als nieuwste fenomeen “AI brain fry”: mentale uitputting door het constant superviseren van AI-tools.

Eigenlijk logisch als je erover nadenkt. AI belooft dat het werk lichter wordt. Maar als niemand bewust nadenkt over wat je met die vrijgekomen tijd doet, wordt het alleen maar zwaarder.

En hier wordt het pijnlijk. Een grote Stanford-studie onder duizenden bestuurders in vier landen toont aan dat de overgrote meerderheid van CEOs en CFOs AI minder dan een uur per week gebruikt. Bijna een derde gebruikt het nooit. Dezelfde leiders verplichten hun werknemers om het dagelijks in te zetten, koppelen het aan beoordelingen, dreigen met consequenties voor wie niet meedoet. Nicholas Bloom, de Stanford-econoom achter het onderzoek, vatte het samen: “De werknemers weten het het beste. Hun bazen hebben de hype omarmd.”

Maar goed, dat is ook logisch. Als je zelf nooit een volle werkdag met een AI-tool hebt gewerkt, hoe herken je dan workload creep bij je team? Hoe weet je dat een AI-samenvatting technisch perfect kan zijn en toch iets essentieels wegneemt?

Hoe je het wel doet

De bedrijven die het goed doen hebben drie dingen gemeen.

Ze beginnen smal en meten alles. Prosus begon niet met vijfduizend agents. Ze begonnen met eenvoudige taken, maten de resultaten, en bouwden van daaruit op naar complexere toepassingen. Die groei naar duizenden dagelijkse agents in minder dan een jaar was geen big bang. Het was organisch, stap voor stap, met bewijs op elke trede.

Ze houden mensen in de loop als hoofdredacteur. Niet als formaliteit. Dat werkt namelijk ook niet: onderzoek laat zien dat mensen na een tijdje gewoon op “goedkeuren” klikken zonder te lezen. De mens moet een rol hebben die ertoe doet. Beoordelen, bijsturen, context toevoegen die AI mist. Het verschil tussen een systeem dat autonoom draait en een systeem waar de mens de regie houdt, is vaak het verschil tussen een implementatie die werkt en eentje die stuk loopt op de werkelijkheid.

Ze meten de menselijke factor, niet alleen de KPIs. Verslagtijd omlaag is mooi. Maar als ziekteverzuim stijgt en je beste mensen vertrekken, heb je een duurder probleem gecreëerd dan je hebt opgelost. Vraag je medewerkers wat ze kwijtraken. Niet alleen wat ze erbij krijgen.

En er is er nog eentje die ik vaak herhaal: gebruik AI zelf voordat je het verplicht voor je team. Serieus. Niet één keer uitproberen en dan beleid maken, maar er dagelijks mee werken. De bestuurders die het zelf nauwelijks gebruiken, zijn het minst gekwalificeerd om te beoordelen hoe het de werkdag van hun mensen verandert.

De balans

Amazon reageerde op hun crashes met wat ze intern een “code safety reset” noemen. Honderden kritieke systemen worden opnieuw doorgelicht. Twee mensen moeten nu elke AI-gerelateerde wijziging reviewen voordat die live gaat. “Controlled friction”, gecontroleerde wrijving.

Dat is precies het goede woord. Wrijving is niet het probleem. Het is de oplossing. De truc is om de juiste hoeveelheid toe te voegen op de juiste plekken. Niet alles automatiseren. Niet alles bij het oude laten. De balans vinden die past bij jouw organisatie en jouw mensen.

In onze callcenter-case was die balans: AI schrijft, mens redigeert. Bij Prosus: medewerkers bouwen zelf agents, maar altijd binnen een beheerd platform met meetbare uitkomsten. Bij Amazon (achteraf): AI mag, maar twee paar ogen moeten meekijken.

Anthropic publiceerde vorige week een studie die laat zien dat het overgrote deel van de taken in software en wiskunde theoretisch door AI geautomatiseerd kan worden. In de praktijk is slechts een derde daadwerkelijk geautomatiseerd. Die enorme kloof? Dat is geen technologisch probleem. Dat is een implementatieprobleem. Juridisch, organisatorisch, menselijk.

De technologie is er. De implementatie is de kunst. En die kunst begint met één vraag die bijna niemand stelt: wat neem je weg als je dit automatiseert?

Dus als iemand je volgende week vertelt dat je “achterloopt” omdat je niet genoeg automatiseert: vraag diegene hoe vaak ze het zelf gebruiken. En vraag ze of ze weten welke onzichtbare pauzeknop ze aan het weghalen zijn.

Ook het vermelden waard

AI ontwerpt kankervaccin voor hond, tumor krimpt 75 procent Een Australische tech-ondernemer gebruikte ChatGPT en Google’s AlphaFold om een gepersonaliseerd mRNA-kankervaccin te ontwerpen voor zijn hond met terminale kanker. Na twee injecties kromp de tumor met 75 procent. Het eerste op maat gemaakte kankervaccin voor een dier, ontworpen door iemand zonder medische achtergrond met tools die iedereen kan gebruiken. Precies het soort implementatie dat wél werkt: AI als versterker van menselijke motivatie en creativiteit.

Pokémon Go-spelers trainden onbewust bezorgrobots Niantic, het bedrijf achter Pokémon Go, heeft dertig miljard afbeeldingen van spelers gebruikt om navigatietechnologie te trainen voor bezorgrobotbedrijf Coco Robotics. Al die foto’s die je maakte terwijl je door je wijk liep op jacht naar een Pikachu? Die leren robots nu hoe ze stoepen, zebrapaden en deuren herkennen. Handig. Maar niemand had het de spelers gevraagd.

EU Parlement wil AI-bedrijven aanpakken op contentroof Het Europees Parlement nam een resolutie aan die oproept tot strengere regels tegen het zonder toestemming gebruiken van auteursrechtelijk beschermd materiaal voor AI-training. In dezelfde week klaagt uitgever Merriam-Webster OpenAI aan voor het trainen op hun woordenboekdefinities. De juridische muren rond AI-trainingsdata worden steeds hoger, en dat gaat uiteindelijk de kostprijs van AI-modellen beïnvloeden.

xAI herbouwt Grok van de grond af, terwijl tieners het bedrijf aanklagen Musks AI-bedrijf xAI begint opnieuw met de ontwikkeling van Grok, nadat eerdere versies “niet goed genoeg” bleken. Tegelijkertijd klagen tieners het bedrijf aan omdat Grok zonder aanleiding expliciet beeldmateriaal van hen genereerde. Senator Elizabeth Warren eist opheldering over xAI’s toegang tot geclassificeerde netwerken van het Pentagon. Geen geweldige week voor xAI.

Lees ook

De race naar AGI (en niemand weet wat het betekent)

AI solliciteert mee (aan beide kanten van de tafel)

Vind je dit waardevol? Deel het.

Stuur THE HUMAN LOOP door naar één collega die ook met AI bezig is. Voor elke vriend die zich aanmeldt, krijg je gratis maanden premium: inclusief alle Playbooks.

Concreet:

2 vrienden = 1 maand.

5 vrienden = 3 maanden.

12 vrienden = een half jaar.