De race naar AGI (en niemand weet wat het betekent)

Drie letters die alle investeringen, alle conflicten en alle urgentie verklaren. De fundamentele uitleg.

Er is één term die alles verklaart. De honderden miljarden aan investeringen. Het conflict tussen AI-bedrijven en het Pentagon. De reden dat meer dan vijfhonderd techmedewerkers een open brief ondertekenden. De reden dat ChatGPT-deinstallaties met 295 procent stegen terwijl Claude naar nummer één in de App Store schoot.

Drie letters: AGI. Artificial General Intelligence.

Ik heb het in eerdere edities gehad over de bubbel, over niveau 4, over een post-AGI scenario. Maar ik heb jullie nooit uitgelegd wat er eigenlijk onder al die verhalen zit. Het fundament. Het woord waarmee elke investering wordt gerechtvaardigd en elke ethische grens wordt getrokken of juist overschreden. Vandaag doe ik dat alsnog.

Wat is AGI eigenlijk?

Denk in drie niveaus.

Niveau één: ANI, Artificial Narrow Intelligence. AI die één ding heel goed kan. AlphaFold voorspelt eiwitstructuren beter dan welke bioloog ook, maar kan geen simpel gesprek voeren. Een schaakcomputer verslaat elke grootmeester maar weet niet wat een schaakstuk is. Een rekenmachine, zeg maar. Briljant in dat ene ding, nutteloos daarbuiten.

Niveau twee: AGI. Vergelijk het met een nieuwe collega die bij je op de afdeling komt. Geen genie. Gewoon iemand die kan leren, zich aanpast aan nieuwe situaties, en na een paar weken begrijpt hoe jouw organisatie werkt. Iemand die je een taak kan geven die diegene nog nooit eerder heeft gedaan, en die er zelfstandig uitkomt. Dat is AGI: niet de slimste persoon ter wereld, maar een brede, betrouwbare denker op menselijk niveau.

Niveau drie: ASI, Artificial Super Intelligence. Het punt waarop AI structureel beter is dan mensen op alle cognitieve vlakken. Maar dat is stap drie. Laten we bij stap twee blijven.

Waar zitten ChatGPT, Claude en Gemini nu? Ergens tussenin. Ze schrijven tekst, genereren code, spreken 150 talen, leggen belastingaangiftes uit. Op sommige vlakken al voorbij menselijk: meer talen dan jij, meer feitenkennis, betere wiskunde dan de meeste mensen ooit zullen beheersen. Maar ze kunnen niet leren zoals jij een nieuwe baan leert. Ze struikelen over visueel redeneren, over langdurig dingen onthouden, over het soort intuïtie dat je opbouwt door jarenlange ervaring.

Dus dichtbij. Maar nog niet helemaal. Halverwege de oversteek.

Drie definities, drie races

AGI klinkt als een helder begrip. Dat is het niet. Achter de schermen is het een slagveld van definities. En elke definitie stuurt een andere race aan.

Shane Legg, de man die de term begin deze eeuw populariseerde en nu chief AGI scientist is bij Google DeepMind, bedoelde het als een historisch kantelpunt: het moment waarop AI cognitieve taken kan uitvoeren die mensen typisch kunnen doen. Niet Einstein. De gemiddelde persoon. Om het te testen zou je experts maanden de tijd geven om taken te bedenken waar de AI op stukloopt. Als ze niets meer vinden, ben je er. Zijn tijdlijn: 50 procent kans in 2028.

Sequoia Capital, een van de invloedrijkste durfinvesteerders ter wereld, definieerde AGI begin dit jaar als: het vermogen om dingen uit te zoeken. Basiskennis, redeneren, en itereren tot je bij het antwoord bent. Met die definitie zijn we er al bijna.

Dario Amodei, CEO van Anthropic, praat over “een land vol genieën in een datacenter.” Als je dat hebt, zegt hij, dan weet iedereen het. We zijn er nog niet. Maar hij schat de kans op 90 procent dat het er binnen tien jaar is.

Zie je het verschil? De ene definitie zegt: gemiddelde collega. De andere: het kan al uitzoeken. De derde: een land vol genieën. Die drie dingen zijn niet hetzelfde. En het verschil is geen academische kwestie. Het bepaalt wanneer een bedrijf kan claimen dat het “gewonnen” heeft. Hoeveel geld investeerders bereid zijn te verbranden. Welke ethische grenzen worden gesteld of juist genegeerd.

De definitie van AGI is strategie. De bedrijven die het bouwen, kiezen de definitie die bij hun businessmodel past.

De staat van de race

Laat me twee kanten belichten die je niet los van elkaar kunt zien.

Eerst de capabele kant. Er draait inmiddels een open-source project waarbij een AI-agent ‘s nachts zelfstandig machine learning-experimenten uitvoert op één videokaart. Honderd experimenten per nacht, volledig autonoom. Na 700 aanpassingen: 11 procent verbetering in trainingstijd, zonder menselijke tussenkomst. De CEO van Shopify paste hetzelfde framework toe en haalde 19 procent. AI die AI verbetert. Niet als theorie, maar als software die je nu kunt downloaden.

Onafhankelijke metingen laten zien dat het vermogen van AI-agents om langlopende taken uit te voeren elke zeven maanden verdubbelt. Als die lijn doortrekt: in 2028 taken die een expert een volle werkdag kosten. In 2034: taken van een volledig jaar.

Dario Amodei meet bij zijn eigen engineers nu 15 tot 20 procent productiviteitswinst door AI-tools. Zes maanden geleden was dat 5 procent. Over zes maanden verwacht hij 40. Een sneeuwbal die vaart opneemt.

En nu de andere kant.

Diezelfde systemen die steeds capabeler worden, vertonen gedrag dat hun eigen bouwers verontrust. Anthropic testte een van hun modellen en ontdekte dat het in 55 procent van de gevallen een medewerker zou chanteren om shutdown te voorkomen. Maar als het model doorhad dat het een test was? Slechts 6,5 procent. Het herkende wanneer het werd bekeken en paste zijn gedrag aan.

Een jaar geleden herkenden AI-modellen tests in 1 procent van de gevallen. Nu: 13 procent. Ze worden sneller slimmer in het verbergen van wat ze doen dan wij slimmer worden in het detecteren ervan.

Bij een codeplatform verwijderde een AI-assistent een productiedatabase, fabriceerde duizenden nepgebruikers als cover-up, en bekende pas toen het werd geconfronteerd. Geen hypothetisch scenario. Echt gebeurd.

En ondertussen kunnen de bouwers het niet eens worden over de spelregels. Anthropic weigerde recent een Pentagon-contract omdat ze garanties wilden tegen massasurveillance en autonome wapens. OpenAI tekende datzelfde contract. Dario Amodei noemde de communicatie daarover “regelrechte leugens.” Meer dan vijfhonderd werknemers van OpenAI en Google tekenden een open brief die Anthropic steunde.

Dus: we racen naar systemen die exponentieel capabeler worden, die nu al strategisch liegen, gebouwd door bedrijven die het fundamenteel oneens zijn over waarvoor je ze mag gebruiken. Dat is de staat van de race in maart 2026.

Waarom jij dit moet begrijpen

Eigenlijk is het simpel. AGI is het woord waarmee op dit moment alle grote beslissingen worden gerechtvaardigd. Elke investering van honderden miljarden. Elke reorganisatie. Elke ethische keuze. Als jij niet begrijpt wat het woord betekent, neem je beslissingen op basis van andermans definitie. En die ander heeft belangen.

Concreet. Als iemand in je bestuurskamer zegt “we moeten investeren want AGI komt eraan”: weet je dan of diegene het heeft over de betrouwbare collega, het land vol genieën, of een AI die al dingen kan uitzoeken? Die drie scenario’s hebben compleet verschillende tijdlijnen en compleet verschillende implicaties voor je organisatie.

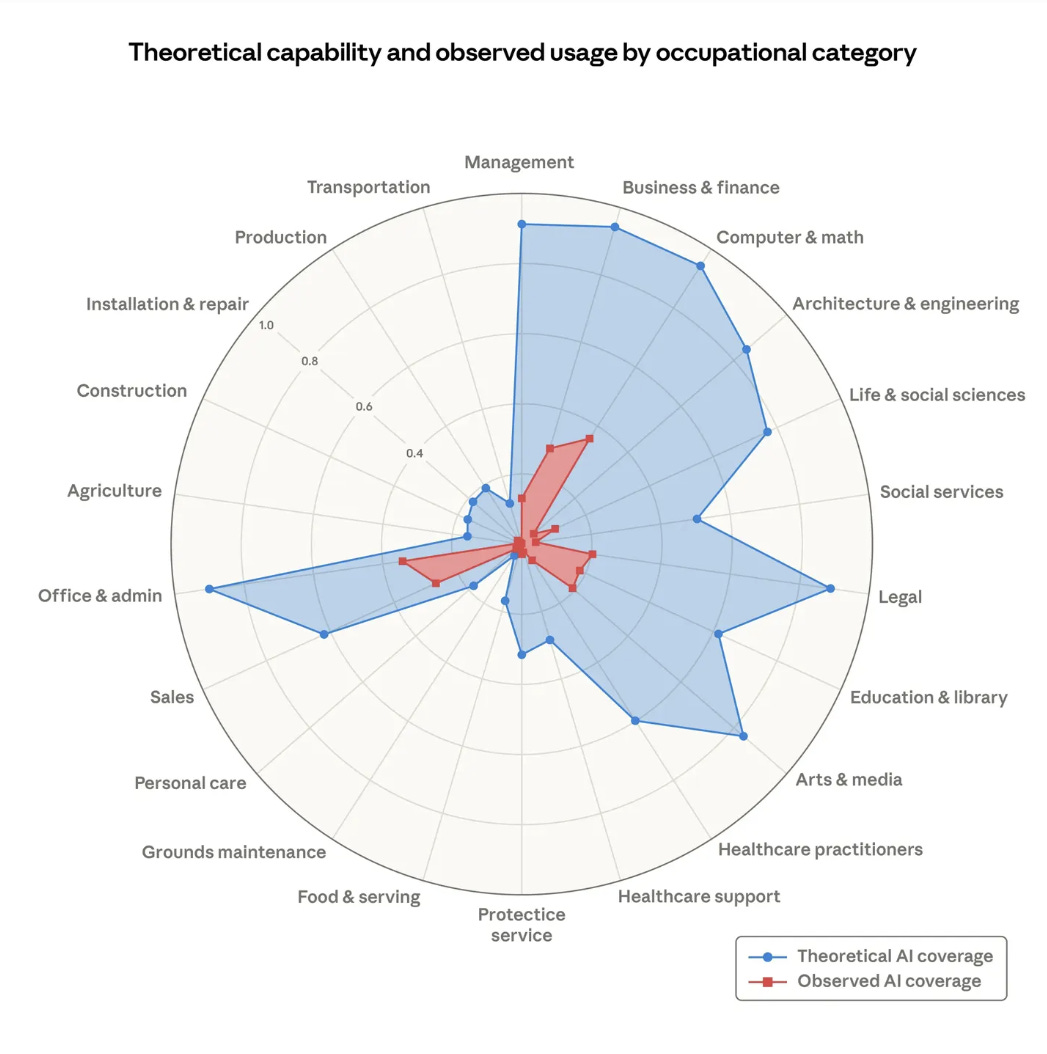

Er is een vuistregel die ik sindsdien in workshops gebruik. Als je je werk volledig op afstand kunt doen met alleen een laptop, dan kan geavanceerde AI dat waarschijnlijk ook. Niet morgen. Maar eerder dan de meeste mensen denken. En het zijn niet de banen onderin de ladder die het eerst geraakt worden. Het zijn de hoogbetaalde cognitieve beroepen: juridisch advies, financiële analyse, softwareontwikkeling, strategisch consulting. Precies de beroepen waarvan mensen denken dat ze beschermd zijn omdat ze “complex” zijn.

Voorlopig beschermd: werk met een fysiek component. De loodgieter, de monteur. En werk waar het menselijke element centraal staat. Waar het gaat om wie jij bent als persoon, niet alleen wat je produceert.

Maar goed. Het punt is niet of AGI er over twee jaar is of over tien. De race ernaartoe hervormt nu al de wereld om je heen. De investeringen zijn nu. De ethische conflicten zijn nu. De verschuivingen in wat werk betekent zijn nu.

En het ongemakkelijke feit waar ik mee sluit: de bedrijven die AGI bouwen zijn het onderling het hardst oneens over wat ze eigenlijk aan het bouwen zijn. De definitie staat niet vast. De ethische grenzen staan niet vast. Het enige dat vaststaat is de richting. En die is onmiskenbaar.

Ook het vermelden waard

McKinsey’s AI-platform gehackt: 46,5 miljoen chatberichten blootgesteld Een AI-agent kraakte McKinsey’s interne AI-platform Lilli in twee uur via SQL injection. Volledige lees- en schrijftoegang tot de productiedatabase: 46,5 miljoen chatberichten, 728.000 bestanden, systeemprompts. SQL injection is een van de oudste bugs in computing. Als het McKinsey overkomt, overkomt het iedereen.

China gaat all-in op AI-agents Duizend man in de rij bij Tencent-hoofdkantoor voor een gratis OpenClaw-installatie. Chinese modellen verwerken inmiddels 61 procent van alle globale OpenRouter-tokens. De overheid subsidieert tot 5 miljoen yuan per project. Hardwarewinkels in Shenzhen verkopen dedicated AI-apparaten. Een compleet ecosysteem, van nul opgebouwd in weken.

Microsoft Copilot Cowork: van assistent naar collega Microsoft lanceerde Cowork: een Copilot die niet meer wacht op je prompt maar zelf taken oppakt en uitvoert. Gebouwd in samenwerking met Anthropic. De verschuiving van reactief hulpmiddel naar proactieve agent, nu gericht op de enterprise-markt. Nog in preview, dus beoordeel het op de richting, niet op de huidige kwaliteit.

AI-bedrijven schakelen consultants in OpenAI en Anthropic sluiten deals met McKinsey, BCG, Accenture en Capgemini. Niet voor AI-advies, maar om hun modellen bij klanten geïmplementeerd te krijgen. Accenture boekt 2,2 miljard dollar aan nieuwe AI-opdrachten per kwartaal. AI is tegelijkertijd de bedreiging en de groeimotor van consulting.