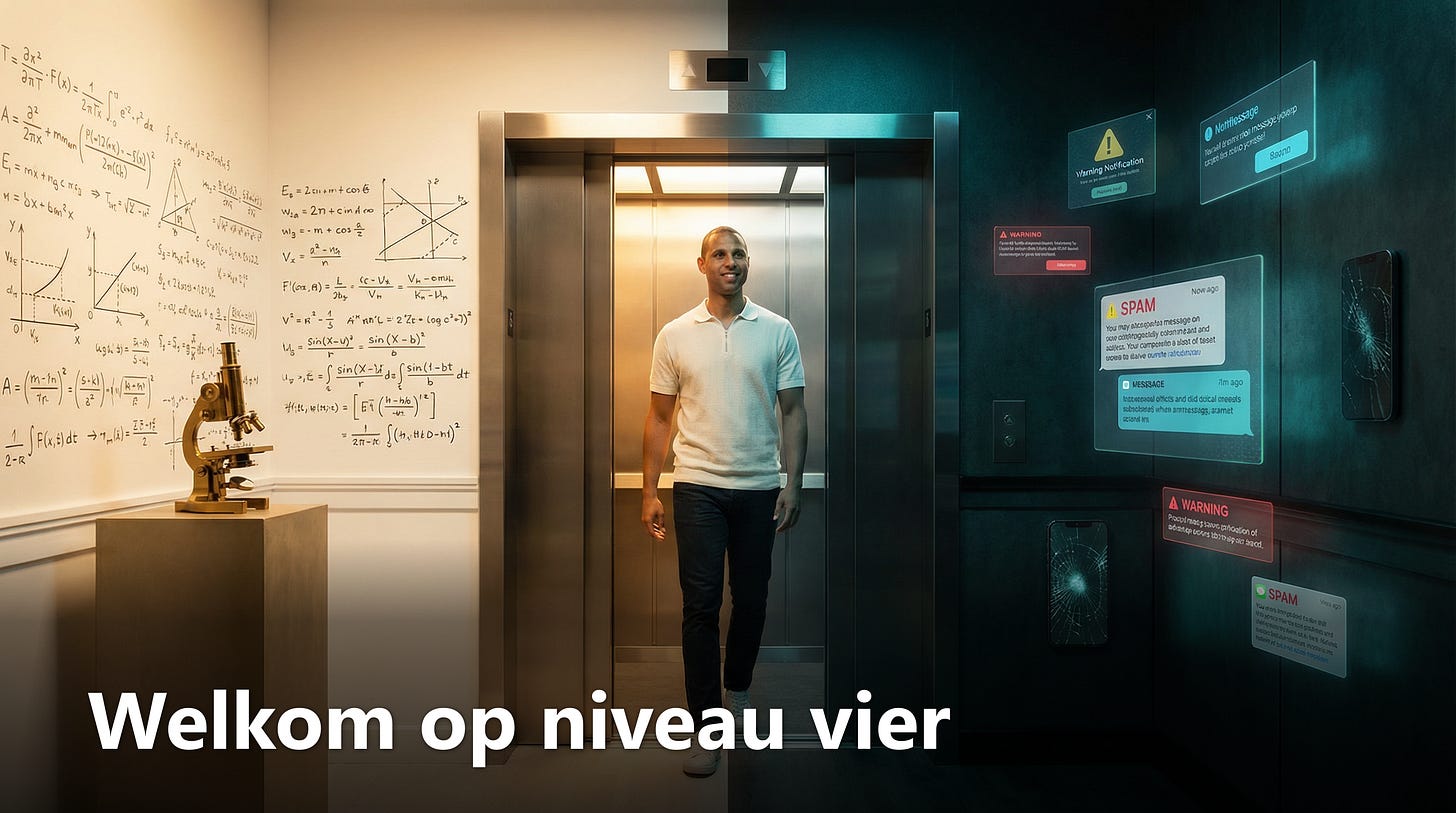

Welkom op niveau vier

OpenAI's AI-routekaart naar superintelligentie: wat niveau 4 betekent voor bedrijven en de toekomst van kunstmatige intelligentie.

Vorige week bewees een AI-model een wiskundige formule waar fysici decennia niet uitkwamen. Een ander model plande een route voor een Marsrover. En diezelfde week werden namen, adressen en telefoonnummers van 6,5 miljoen Nederlanders gestolen bij Odido.

Gebeurtenissen die op het eerste gezicht niks met elkaar te maken hebben. Maar ze vertellen hetzelfde verhaal. En de sleutel is een les die ik in elke workshop herhaal: AI is een briljante generalist, maar een beroerde specialist. Totdat iemand investeert in het specialist maken ervan. En die iemand kan een natuurkundige zijn… of een crimineel.

Van chatbot naar uitvinder in achttien maanden

In de zomer van 2024 deelde OpenAI intern een routekaart met vijf niveaus richting superintelligentie. Niveau 1: chatbots die een gesprek kunnen voeren. Niveau 2: denkers die problemen op PhD-niveau oplossen. Niveau 3: agents die zelfstandig taken uitvoeren. Niveau 4: uitvinders, AI die bijdraagt aan wetenschappelijke ontdekkingen. Niveau 5: organisaties, AI die het werk van een heel bedrijf doet.

Toen die routekaart uitkwam, zei OpenAI dat ze op niveau 1 zaten. Dat is achttien maanden geleden.

Wat er sindsdien is gebeurd: ChatGPT leerde redeneren (niveau 2). AI-agents gingen in productie bij Goldman Sachs en in code-editors over de hele wereld (niveau 3, waar we het de afgelopen twee edities uitgebreid over hadden). En vorige week verscheen het eerste harde bewijs van niveau 4.

Even concreet. Onderzoekers van Harvard, Cambridge en het Institute for Advanced Study werkten samen met OpenAI aan een probleem in de deeltjesfysica. Het ging over gluonen, de deeltjes die de sterke kernkracht dragen. Decennialang namen fysici aan dat bepaalde interacties tussen gluonen simpelweg niet konden plaatsvinden. Ze waren nul. Punt.

De wiskundigen hadden tot n=6 met de hand bewezen dat die interacties toch bestonden, maar de berekeningen werden zo complex dat ze vastliepen. Toen nodigde een van de onderzoekers het team uit bij OpenAI. GPT-5.2 Pro stelde een elegante, algemene formule voor die werkte voor elke waarde van n. Mooi. Maar hij kon het niet bewijzen.

Vervolgens werd een intern model losgelaten op het bewijs. Dat model dacht twaalf uur onafgebroken na. En bewees de formule. OpenAI lanceerde er meteen een nieuwe afdeling voor: OpenAI for Science.

En dan die Marsrover. Op 8 en 10 december 2025 voerde NASA’s Perseverance de eerste ritten uit die volledig door AI waren gepland. Claude, het model van Anthropic (ja, dezelfde Claude die mensen gebruiken om e-mails te schrijven), analyseerde satellietbeelden van het Marsoppervlak en plande een pad van vierhonderd meter door een rotsenveld. De engineers van JPL hoefden nauwelijks iets aan te passen. Planningtijd gehalveerd.

Vierhonderd meter klinkt niet ver. Het is een rondje hardloopbaan. Maar het is een rondje op een andere planeet, gepland door een AI.

Briljante generalist, beroerde specialist

Eigenlijk vertellen die twee doorbraken een verrassend verhaal. Achter elke doorbraak zit dezelfde les: iemand heeft geïnvesteerd in het specialist maken van AI voor een specifiek probleem.

Want dat is iets wat ik in elke training of workshop vertel. AI is van zichzelf een briljante generalist. Het kan een beetje van alles. E-mails schrijven, code genereren, teksten samenvatten. Redelijk goed, voor de meeste dingen die je het vraagt. Maar wil je er een specialist van maken, dan moet je daar echt iets voor doen. De juiste context geven. Het probleem goed afbakenen. De goede prompts schrijven. De juiste skills meegeven.

En dat is precies wat die fysici deden. Ze gaven het model een specifiek, wiskundig exact gedefinieerd probleem. Ze werkten maandenlang samen met OpenAI aan de juiste opzet. Het model dacht vervolgens twaalf uur na over dat ene bewijs. Dat is geen generalist die even snel iets doet. Dat is een specialist, gebouwd voor één taak.

Hetzelfde bij de Marsrover. JPL-engineers configureerden Claude specifiek voor routeplanning op Mars. Satellietbeelden als input, Rover Markup Language als output, duidelijke beperkingen over wat de rover wel en niet kan. Weer een specialist, op maat gemaakt voor één taak.

Dat dit werkt, is indrukwekkend. Maar het bewijs dat de generalist faalt, is net zo overtuigend. Diezelfde week verscheen een onderzoek dat AI-modellen testte op 240 echte opdrachten van Upwork, een internationaal freelance-platform waar zzp’ers en freelancers opdrachten aannemen. Gemiddelde opdrachtwaarde: 630 dollar. Het beste AI-model scoorde een slagingspercentage van 3,75%. Dat is een faalpercentage van ruim 96%. Corrupte bestanden, incompleet werk, kwaliteitsproblemen.

Waarom? Omdat die 240 opdrachten precies het type werk zijn waar niemand investeert in het specialist maken van AI. Rommelige briefings, onduidelijke eisen, menselijke context die je niet in een prompt kunt vangen. De generalist op z’n slechtst.

Dus AI is tegelijkertijd de beste natuurkundige ter wereld en de slechtste freelancer. En dat is precies het punt: het verschil zit in de investering die iemand doet om er een specialist van te maken.

De andere kant van hetzelfde instrument

En hier wordt het urgent. Want diezelfde logica werkt ook aan de andere kant.

Vorige week werd Odido gehackt. Namen, adressen, telefoonnummers, geboortedata van 6,5 miljoen Nederlanders zijn buitgemaakt. Dat raakt bijna ieder huishouden. Op zichzelf al erg.

Maar combineer dit met wat er aan de andere kant van het spectrum gebeurt. AI-agents kunnen inmiddels synthetische stemmen genereren. Een agent kan een restaurant bellen om een reservering te maken. Klinkt handig. Maar diezelfde technologie, gecombineerd met 6,5 miljoen gestolen persoonsgegevens? Dan heb je duizenden autonome agents die tegelijkertijd mensen bellen, mailen en whatsappen. Geautomatiseerd. Gepersonaliseerd. Tegen bijna nul kosten. Met jouw naam, adres en geboortedatum als context. Dat is een specialist in social engineering, op maat gebouwd.

Een bekende tech-ondernemer voorspelde vorige week dat binnen negentig dagen alle communicatiekanalen die we veilig achtten (iMessage, telefoon, Gmail) zo overspoeld worden door AI-gestuurde automatisering dat ze onbruikbaar worden. Onze infrastructuur is gebouwd voor communicatie tussen mensen. En die aanname houdt geen stand zodra agents autonoom gaan handelen.

Dus de microscoop en het wapen zitten in hetzelfde instrument. Het verschil is wie investeert in het specialist maken ervan, en waarvoor.

Wat je wel (en niet) moet doen

Eerste impuls bij dit soort nieuws: of je gaat in de hype mee, of je wuift het weg. Beide is niet handig.

Wat wel handig is: begrijp dat het verschil zit in de investering. De natuurkunde-doorbraak was mogelijk omdat onderzoekers maanden investeerden in het specialist maken van AI. Duidelijke regels, duidelijk doel, verifieerbaar resultaat. Zoek in je eigen werk naar dat type problemen. Specifieke, afgebakende taken waar je vastloopt op complexiteit of volume. En investeer in het specialist maken van AI daarvoor. Goede prompts, de juiste context, duidelijke kaders.

Spotify vertelde vorige week tijdens hun kwartaalcijfers dat hun beste developers sinds december geen regel code meer hebben geschreven. Ze bouwden een intern AI-systeem genaamd Honk, gespecialiseerd op hun eigen codebase. Het resultaat: meer dan vijftig nieuwe features in 2025, en senior engineers die nu code beoordelen in plaats van schrijven. De rol verschuift van uitvoeren naar sturen. Van typen naar beoordelen. En dat is precies het punt: Spotify investeerde in het specialist maken van AI voor hun specifieke werkprocessen. Dat is de investering die het verschil maakt.

Nog een voorbeeld: de CTO van een Amerikaans mediabedrijf reorganiseerde zijn tech-team zes maanden geleden van 63 naar 43 mensen. De output verdubbelde. Elke engineer levert twee tot drie keer meer op dan een jaar geleden. Weer dezelfde les: specialist maken loont.

Dus als je consultant bent: zoek de momenten waar AI specialist kan worden in jouw domein. Patronen in data, verbanden in documenten, inconsistenties in rapportages. Daar zit de waarde. Maar gooi het niet zomaar een vage opdracht toe en verwacht een wonder. Dat is de generalist-valkuil waar 96% van die Upwork-opdrachten in trapte.

Als je manager bent: de bottleneck verschuift van het maken naar het beoordelen. De mensen die het verschil gaan maken zijn degenen die weten hoe ze AI specialist maken voor hun specifieke werk.

En voor iedereen: neem de andere kant serieus. Wees kritisch op onverwachte telefoontjes en berichten. De komende maanden gaat de grens tussen menselijke en AI-communicatie sneller vervagen dan de meeste mensen verwachten. Zeker nu de persoonsgegevens van 6,5 miljoen Nederlanders op straat liggen na de Odido-hack.

Maar goed. Niveau 4 is vooral een signaal. Het instrument is er. Het kan de deeltjesfysica openbreken en een route over Mars plannen. Het kan ook 6,5 miljoen mensen bellen met een synthetische stem. De vraag is of jij investeert in het specialist maken ervan voor je eigen werk. Of dat je het aan anderen overlaat.

Ook het vermelden waard

Microsoft bouwt eigen AI-modellen, laat OpenAI los Mustafa Suleyman, hoofd AI bij Microsoft, bevestigde aan de Financial Times dat het bedrijf eigen frontier-modellen gaat bouwen. “We moeten onze eigen modellen ontwikkelen, op het absolute front, met gigawatt-schaal compute.” De samenwerking met OpenAI gaat door, maar Microsoft positioneert zich als directe concurrent. Het AI-oligopolie brokkelt af.

IBM huurt drie keer meer Gen Z in na grenzen van AI Uit onderzoek van Korn Ferry blijkt dat 37% van organisaties overweegt junior-functies te vervangen door AI. IBM doet het tegenovergestelde. Ze verdrievoudigen hun instapprogramma’s voor Gen Z. De reden: ze ontdekten dat AI-adoptie plafonds heeft en dat je ervaren mensen nodig hebt die AI effectief kunnen aansturen.

VS zette Claude in bij militaire operatie in Venezuela Volgens de Wall Street Journal zette het Amerikaanse leger Claude van Anthropic in bij de operatie tegen Maduro in Venezuela. Het model werd ingezet via Palantir. Anthropic heeft een Pentagon-contract van 200 miljoen dollar. AI in militaire context is niet nieuw, maar de bevestiging dat een commercieel conversatiemodel wordt ingezet bij operaties, dat is een stap verder.

Solo-developer bouwt snelstgroeiende GitHub-repo, verkocht aan OpenAI Peter Steinberger koppelde Claude’s API aan Telegram in een avond. Drie maanden later: 194.000 GitHub-sterren, sneller groeiend dan React en Linux ooit deden. Zuckerberg stuurde hem WhatsApp-berichten, Altman bood compute-deals aan. Steinberger tekende bij OpenAI. Het open-source project gaat naar een stichting. De les: de agent-laag hoeft niet gebouwd te worden door de modelbouwer.