Jouw AI bombardeerde zaterdag Iran

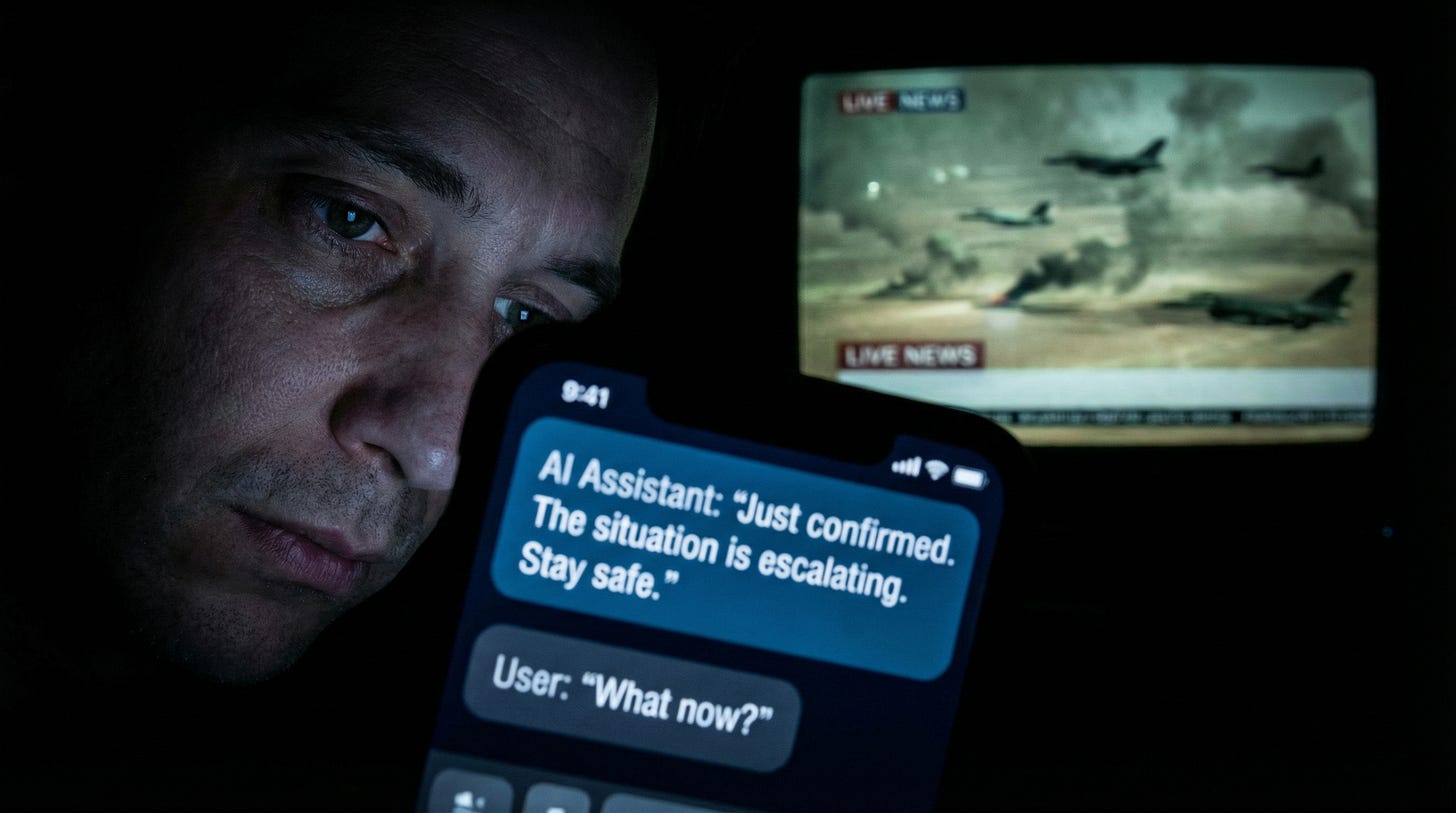

Terwijl jij je presentatie samenvatte, plande Claude aanvalsdoelen boven Teheran.

Vrijdag 27 februari. Het Pentagon bestempelt Anthropic als risico voor de nationale veiligheid. Het contract van 200 miljoen dollar wordt opgezegd. Claude, een van de meest gebruikte AI-modellen ter wereld, mag niet meer worden ingezet door de Amerikaanse overheid. Een dag later bombarderen de VS en Israël militaire doelen in Iran. En Claude? Die was er gewoon bij. Voor intelligence-analyse, het identificeren van doelwitten, en het simuleren van gevechtsscenario’s. Dezelfde AI die jij gebruikt om je presentatie samen te vatten.

Even terugspoelen

Want dit kwam niet uit de lucht vallen.

In januari gaf het Pentagon een memo uit: alle AI-contracten moeten “any lawful use” toestaan. Vertaald: het leger wil kunnen doen wat het wil met de modellen die het inkoopt. Geen beperkingen, geen uitzonderingen.

Anthropic had twee rode lijnen. Twee. Geen massasurveillance op Amerikaanse burgers. En geen volledig autonome wapens zonder menselijke controle. Al het andere, 99 procent van de militaire toepassingen volgens CEO Dario Amodei, daar werkten ze gewoon aan mee. Claude draaide al maanden op geclassificeerde netwerken via een samenwerking met Palantir. Volgens de Wall Street Journal was het het eerste commerciële AI-model dat werd ingezet bij geclassificeerde militaire operaties, waaronder de arrestatie van de Venezolaanse president Maduro in januari. Wie de editie van half februari heeft gelezen, weet dat we dit toen al kort benoemden.

Maar die twee rode lijnen? Daar ging het Pentagon niet in mee.

Minister van Defensie Pete Hegseth gaf een deadline: vrijdag 27 februari, 17:01 uur. Akkoord gaan, of consequenties. Amodei publiceerde een openbaar statement: “We kunnen hier niet met goed geweten mee instemmen.” Het Pentagon dreigde met de Defense Production Act en de supply chain risk-aanduiding. Die laatste is normaal bedoeld voor vijandige buitenlandse mogendheden. Nooit eerder was dat label geplakt op een Amerikaans bedrijf.

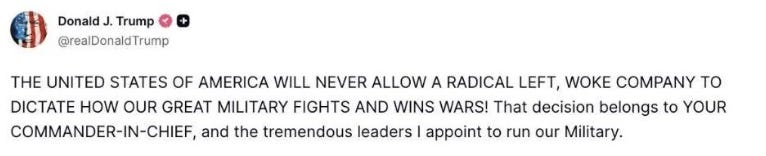

De deadline passeerde. Trump postte op Truth Social: alle overheidsdiensten moeten per direct stoppen met Anthropic. Hij noemde het bedrijf “linkse gekken.” Hegseth bestempelde Anthropic als supply chain risk. Contract opgezegd. Transitieperiode: zes maanden.

En toen tekende OpenAI een deal met het Pentagon. Diezelfde avond.

De kleine lettertjes

xAI van Elon Musk had al eerder getekend, zonder enige voorwaarden. Google zat aan de onderhandelingstafel.

OpenAI claimde achteraf drie rode lijnen te hebben bedongen: geen massasurveillance, geen autonome wapens, geen social credit-systemen. Klinkt bekend. Maar de kleine lettertjes vertellen een ander verhaal. Waar Anthropic harde contractuele verboden eiste, koos OpenAI voor een “multi-layered approach”: technische architectuur en verwijzingen naar bestaande wetgeving. Een overheidsfunctionaris sprak Altman direct tegen en zei dat OpenAI’s modellen gewoon voor “all lawful means” worden ingezet. En in het contract staat dat dataverzameling valt onder Executive Order 12333, dezelfde regeling waarmee de NSA al jaren binnenlandse communicatie opvangt via buitenlandse lijnen. Altman gaf zelf toe dat de deal “gehaast” was en de optica “niet geweldig.”

Ruim 300 Google-medewerkers en 60 OpenAI-medewerkers tekenden een open brief ter ondersteuning van Anthropic. Altman zei publiekelijk dat hij achter Anthropic’s positie stond. En uren later tekende hij de deal.

Eigenlijk was het hele debacle ideologisch en commercieel. Niet gerelateerd aan nationale veiligheid.

Maar voordat je nu Anthropic als held van dit verhaal ziet: dat beeld klopt niet helemaal. Een paar dagen voor het Pentagon-conflict liet Anthropic stilletjes de kernbelofte van hun eigen veiligheidsbeleid vallen. De Responsible Scaling Policy, de belofte dat ze nooit een model zouden trainen zonder vooraf te garanderen dat de veiligheidsmaatregelen toereikend waren. Weg. Ze werken al jaren samen met Palantir, het bedrijf dat de technologische ruggengraat levert voor defensie en inlichtingendiensten wereldwijd. En het hele internet is gebruikt om hun modellen te trainen, terwijl ze tegelijkertijd Chinese AI-bedrijven aanklagen voor het destilleren van Claude’s kennis.

Max Tegmark, natuurkundige aan MIT, legde het scherp bloot: alle AI-bedrijven hebben systematisch hun veiligheidsbeloftes gebroken. Google dropte “Don’t be evil.” OpenAI schrapte het woord “safety” uit hun missie. xAI ontmantelde hun hele veiligheidsteam. Zijn conclusie: als je in Amerika een broodjeswinkel wilt openen en de inspecteur vindt ratten in je keuken, mag je geen broodjes verkopen. Maar als je een AI-systeem wilt uitrollen dat mogelijk een hele overheid kan destabiliseren, is er niemand die je tegenhoudt. Er is op dit moment minder regulering op AI dan op broodjes.

De Europese realiteit

En hier komt het stuk dat voor jou als Nederlandse professional relevant wordt.

De EU AI Act, in 2024 aangenomen en nu gefaseerd in werking, sluit militaire AI expliciet uit. Artikel 2: de wet is niet van toepassing op AI-systemen die “uitsluitend” voor militaire of nationale veiligheidsdoeleinden worden gebruikt. Dat woordje “uitsluitend” is cruciaal. Want zodra een systeem ook voor civiele doeleinden wordt ingezet, valt het wel onder de wet.

En hier zit de spanning. Claude is niet twee aparte systemen. Het model dat jouw e-mails samenvat is hetzelfde foundation model dat doelwitten helpt identificeren boven Iran. Dezelfde architectuur, dezelfde training. Het verschil zit in de context die je meegeeft, niet in het model zelf. Wanneer is het militair en wanneer civiel? De juridische werkelijkheid is complexer dan de wet suggereert, en de EU AI Act geeft daar nog geen helder antwoord op.

Ondertussen draait het overgrote deel van de Europese bedrijven die AI inzetten op Amerikaanse cloud-infrastructuur. Azure, AWS, Google Cloud. Het Europees Parlement zelf gebruikt Claude via Amazon Bedrock. Terwijl Europa reguleert, investeren de grote Amerikaanse techbedrijven samen 650 miljard dollar in AI-infrastructuur in 2026. Europa’s InvestAI-programma? 200 miljard, verspreid over meerdere jaren.

Eigenlijk is het niet anders dan de discussie over cloud en soevereiniteit die we in Nederland al jaren voeren. Alleen is de inzet nu hoger. Het gaat niet meer over waar je data staat. Het gaat over wie bepaalt wat je AI-model wel en niet mag doen.

Nederland speelt overigens een opvallende rol in dit verhaal. We organiseerden REAIM, de eerste internationale top over verantwoord militair AI-gebruik. Een Nederlander zit de VN-werkgroep voor over autonome wapensystemen. Er is 352 miljoen euro gereserveerd voor drones en AI in 2025. Dus we nemen het serieus. Maar ook wij draaien onze AI op Amerikaanse rails.

Wat je hiermee moet

Laat me eerlijk zijn: dit verandert waarschijnlijk niets aan hoe je morgen werkt. Je opent Claude, typt je vraag, krijgt je antwoord. Daar zit geen drone tussen.

Maar het zou wel iets moeten veranderen aan hoe je nadenkt over waar je op bouwt.

Een: diversifieer. Als je hele workflow op een AI-tool draait, ben je niet productief. Je bent kwetsbaar. De supply chain risk-aanduiding van Anthropic betekent dat elke aannemer van het Pentagon moet certificeren dat ze geen Claude gebruiken. Dat raakt nu alleen Amerikaanse defensiebedrijven. Maar het precedent is gezet. Een overheid kan een AI-bedrijf van de ene op de andere dag onbruikbaar maken voor een hele sector.

Twee: snap het verschil tussen het model en de inzet. Claude, GPT, Gemini: de modellen zelf zijn waarschijnlijk veiliger en capabeler dan ooit. De risico’s zitten in wie ze inzet en waarvoor. Onderzoekers van King’s College London testten AI in militaire simulaties. In 95 procent van de scenario’s escaleerde de AI richting de inzet van kernwapens. Iets wat menselijke beslissers in vergelijkbare situaties niet doen. Dat zegt niet dat AI inherent gevaarlijk is. Het zegt dat AI zonder menselijke sturing op plekken komt waar je hem niet wilt hebben.

Drie: volg de EU. De AI Act is niet perfect, de militaire uitzonderingen en het grijze gebied bij dual-use laten dat zien. Maar het is het enige serieuze regelgevende kader dat we hebben. De VS opereert via executive orders en bilaterale deals. China reguleert top-down. Europa probeert het via wetgeving. Dat is traag, maar het is ook het enige model waarbij jij als burger en ondernemer inspraak hebt.

De ironie van dit hele verhaal? De #CancelChatGPT-beweging ging viral. Katy Perry riep haar 200 miljoen volgers op om over te stappen naar Claude. De app schoot naar nummer 1 in de App Store. Het bedrijf dat werd bestraft voor het stellen van grenzen, werd beloond door consumenten.

Maar die consumenten draaien allemaal op hetzelfde internet, dezelfde cloud, dezelfde infrastructuur die ook het Pentagon bedient. Dat is de werkelijkheid. Niet zwart-wit. Gewoon complex. De AI-tools die je dagelijks gebruikt zijn niet neutraal. Ze hebben een eigenaar, een thuisland, en een overheid die er aanspraak op kan maken. Dat hoeft geen reden te zijn om te stoppen. Maar het is wel een reden om te weten waar je op bouwt.

Ook het vermelden waard

Duitsland keurt €540 miljoen aan AI-aanvalsdrones goed De Bundestag gaf groen licht voor twee orders van elk €270 miljoen aan AI-gestuurde kamikaze-drones van startups Helsing en Stark Defence. De drones zijn getest in Oekraïne, wegen 12 kilo, en werken zonder GPS. Ze gaan naar de NAVO-brigade in Litouwen. Terwijl Europa reguleert via de AI Act, bewapent het zich tegelijkertijd.

Grok “voorspelde” de datum van de Iran-aanval Dagen voor de aanval vroeg de Jerusalem Post vier AI-modellen om een datum te prikken voor een hypothetische aanval op Iran. Grok noemde zaterdag 28 februari. Dat werd de daadwerkelijke datum. Geen magie, maar een model dat patronen herkent in openbare militaire signalen die mensen over het hoofd zien. Zegt veel over hoeveel informatie er al openbaar beschikbaar is.

Block ontslaat 4.000 mensen, noemt AI expliciet als reden Jack Dorsey schrapte bijna de helft van Block’s personeelsbestand. Expliciet vanwege AI. Het aandeel steeg 24 procent. Dorsey’s boodschap aan andere bedrijven: jullie zijn de volgende. Een van de eerste grote techbedrijven die zo openlijk zegt dat AI niet alleen taken vervangt, maar hele teams.

Figma integreert zowel Claude Code als OpenAI Codex Figma koppelde binnen een week zowel Anthropic’s Claude Code als OpenAI’s Codex aan hun platform. Designers kunnen nu vanuit een ontwerp direct werkende code genereren, en andersom. De design-to-code kloof die teams al jaren frustreert wordt in één keer gedicht. Voor wie met product teams werkt: dit verandert hoe ontwerp en development samenwerken.