De kans is groot dat je als ondernemer of manager de afgelopen tijd twee dingen hebt gevoeld: de enorme potentie van AI en een knagende onzekerheid over de regels. Je ziet hoe AI processen kan versnellen en nieuwe deuren opent, maar tegelijkertijd hoor je over de ‘AI Act’. Een complex web van Europese wetgeving, torenhoge boetes en vage verplichtingen. Het voelt als de AVG op steroïden, en de gedachte aan wéér een compliance-traject zorgt voor hoofdpijn.

De angst voor de complexiteit verlamt de vooruitgang. Veel bedrijven steken hun kop in het zand, hopend dat het overwaait. Maar de AI Act is geen toekomstmuziek; de eerste deadline was al in februari 2025. Wachten is geen optie.

Maar wat als er een andere weg is? Een weg waarbij je niet verdwaalt in juridisch jargon, maar met een heldere, praktische routekaart precies weet wat je moet doen? Dit playbook is die routekaart. We nemen de complexiteit weg en geven jou de controle terug. Dit is hoe je de AI Act tackelt, stap voor stap.

De Basis: Wat is de AI Act en Waarom Moet Je Opletten?

De AI Act is 's werelds eerste uitgebreide wet voor kunstmatige intelligentie, in werking getreden op 1 augustus 2024. Zie het als de nieuwe spelregels voor het ontwikkelen en gebruiken van AI in Europa. Het doel is simpel: innovatie stimuleren en tegelijkertijd de veiligheid en fundamentele rechten van burgers beschermen.

De wet werkt met een risicogebaseerde aanpak. Hoe groter het potentiële risico van een AI-systeem, hoe strenger de regels. Dit is cruciaal, want het betekent dat niet elke AI-tool onder een vergrootglas ligt. De meeste AI-toepassingen die je vandaag gebruikt, vallen in de laagste risicocategorie.

Maar let op: de wet geldt voor iedereen die AI-systemen ontwikkelt, aanbiedt of gebruikt binnen de EU-markt. Zelfs als je bedrijf in de VS of Azië is gevestigd, maar je levert diensten aan Europese klanten, val je onder de AI Act. Negeren is dus geen optie.

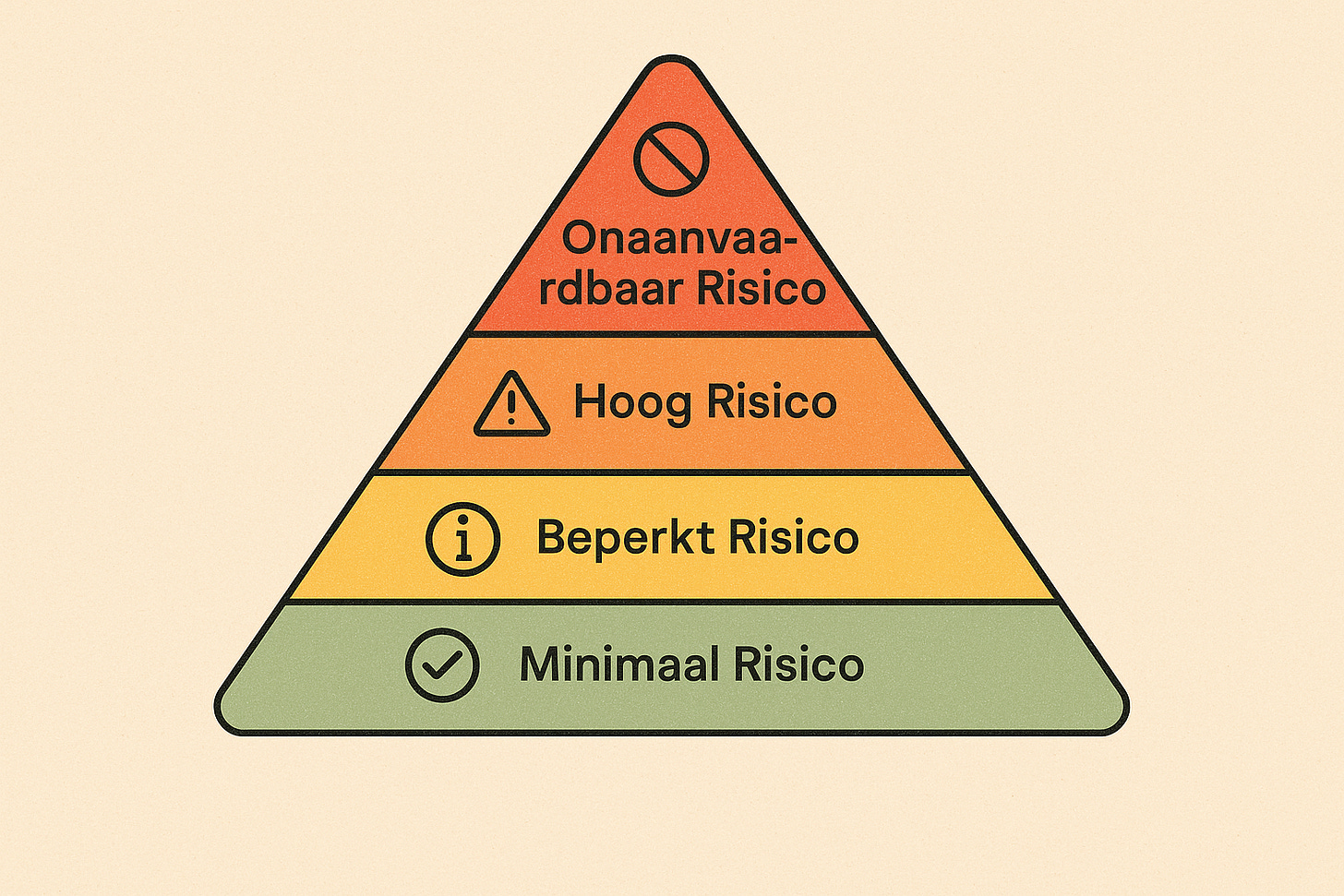

De Risico-Pyramide: Waar Valt Jouw AI-systeem?

Alles begint met het classificeren van je AI-systemen. De wet kent vier niveaus, van volledig verboden tot vrijwel ongereguleerd.

Niveau 1: Onaanvaardbaar Risico (Verboden)

Dit zijn AI-toepassingen die een duidelijke bedreiging vormen voor onze waarden en rechten. Deze systemen zijn vanaf 2 februari 2025 verboden. Denk aan:

Social scoring: Systemen die burgers beoordelen op basis van hun gedrag, zoals in China.

Manipulatieve AI: Technologie die menselijk gedrag onbewust beïnvloedt om schade te veroorzaken.

Kwetsbaarheden uitbuiten: AI die misbruik maakt van de zwaktes van specifieke groepen (bv. kinderen, ouderen).

Emotieherkenning op de werkvloer en in het onderwijs: Het monitoren van de emotionele staat van werknemers of studenten.

Actie vereist: Gebruik je (onderdelen van) dit soort technologie? Stop er onmiddellijk mee.

Niveau 2: Hoog Risico (Strikt Gereguleerd)

Dit is de belangrijkste categorie van de AI Act. Systemen die een significante impact kunnen hebben op iemands leven, veiligheid of rechten vallen hieronder. De regels voor deze systemen worden volledig van kracht in augustus 2026. Voorbeelden zijn AI in:

Werkgelegenheid: CV-scanners, tools voor promotiebeoordelingen.

Onderwijs: Systemen voor toelating of examenbeoordeling.

Essentiële diensten: Kredietbeoordeling voor leningen, bepalen van recht op uitkeringen.

Medische hulpmiddelen: AI voor diagnoses of chirurgische robots.

Rechtshandhaving en justitie: Risico-inschattingen van verdachten.

Actie vereist: Als je een hoog-risico systeem ontwikkelt of gebruikt, moet je voldoen aan een waslijst van strenge eisen, waaronder risicomanagement, hoge datakwaliteit, technische documentatie, menselijk toezicht en cybersecurity. Hier duiken we later dieper op in.

Niveau 3: Beperkt Risico (Transparantieplicht)

Hieronder vallen AI-systemen waarbij het risico vooral in misleiding zit. De enige verplichting is transparantie. Gebruikers moeten weten dat ze met een AI te maken hebben.

Chatbots en virtuele assistenten: Moeten zich identificeren als AI.

Deepfakes en AI-gegenereerde content: Moeten als zodanig gelabeld worden.

Actie vereist: Zorg voor duidelijke labels en meldingen in je user interface.

Niveau 4: Minimaal Risico (Vrijwel Vrijgesteld)

De overgrote meerderheid van de AI-systemen valt hieronder. Denk aan:

Spamfilters

Aanbevelingsalgoritmes in webshops

AI in videogames

Actie vereist: Geen specifieke verplichtingen onder de AI Act. Vrijwillige gedragscodes worden wel aangemoedigd.

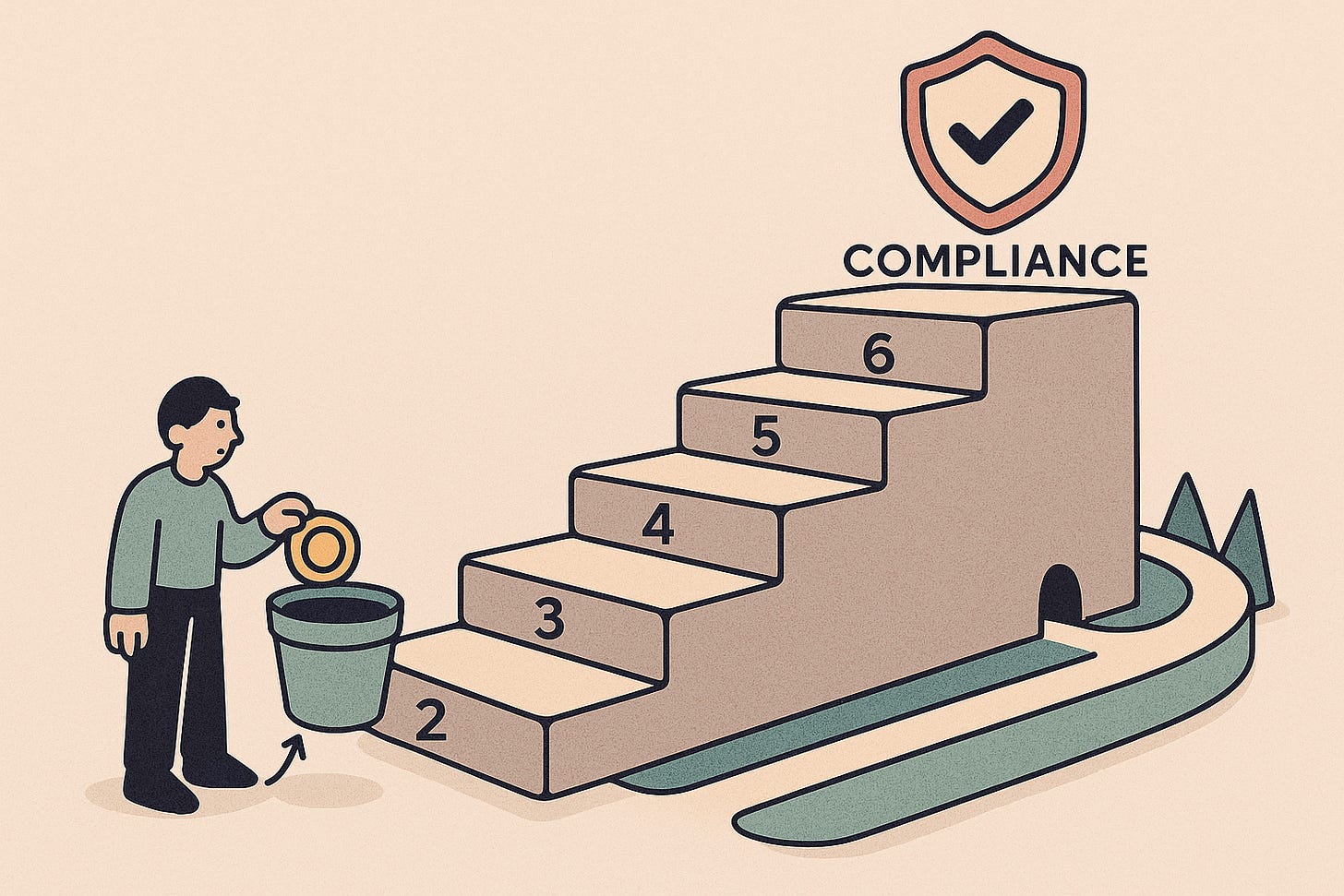

Jouw 6 Stappen naar Compliance

Oké, de theorie is helder. Maar waar begin je in de praktijk? Volg deze zes stappen om je organisatie voor te bereiden.

Stap 1: Inventariseer je AI-systemen

Je kunt niet managen wat je niet meet. De eerste stap is een compleet overzicht maken van alle AI die je in huis hebt.

Wat moet je doen? Maak een register van elk AI-systeem. Vraag je af: welke software gebruiken we die leert van data of autonoom beslissingen neemt? Betrek IT, inkoop en de business. Veel standaardsoftware heeft tegenwoordig ingebouwde AI-componenten.

Praktische tip: Begin met een simpele spreadsheet. Noteer per systeem: de naam, de leverancier, het doel en welke afdeling het gebruikt.

Stap 2: Classificeer het Risico

Nu je de lijst hebt, classificeer je elk systeem volgens de risico-piramide.

Wat moet je doen? Bepaal per systeem: is het risico onaanvaardbaar, hoog, beperkt of minimaal? Bepaal ook je rol: ben je een provider (ontwikkelaar) of een deployer (gebruiker)? De verplichtingen verschillen.

Praktische tip: Gebruik een online self-assessment tool van een betrouwbare partij om een eerste inschatting te maken. Bij twijfel, classificeer hoger en zoek advies.

Stap 3: Duik in de Vereisten (voor Hoog-Risico Systemen)

Als je hoog-risico systemen hebt geïdentificeerd, is dit de kern van je werk. Je moet voldoen aan strenge eisen. De belangrijkste zijn:

Risicomanagement: Identificeer, evalueer en beperk continu de risico's van het systeem.

Data Governance: Gebruik hoogwaardige, representatieve en onbevooroordeelde datasets. Documenteer waar je data vandaan komt.

Technische Documentatie: Houd een gedetailleerd logboek bij over hoe het systeem is gebouwd, getraind en gevalideerd. Dit moet op verzoek beschikbaar zijn voor toezichthouders.

Menselijk Toezicht: Ontwerp het systeem zo dat een mens altijd kan ingrijpen, de output kan controleren en een beslissing kan overrulen.

Cybersecurity & Robuustheid: Zorg dat het systeem accuraat, betrouwbaar en veilig is tegen manipulatie.

Stap 4: Implementeer AI-Geletterdheid in je Team

Een van de eerste verplichtingen (vanaf 2 februari 2025) is AI-geletterdheid.

Wat moet je doen? Zorg ervoor dat medewerkers die met AI-systemen werken, de basis begrijpen: wat zijn de kansen, wat zijn de risico's, en hoe bedien je het systeem op een verantwoorde manier?

Praktische tip: Start een intern trainingsprogramma. Dit hoeft niet complex te zijn. Begin met een basisworkshop over AI-ethiek en de AI Act voor de relevante teams. Documenteer wie welke training heeft gevolgd.

Stap 5: Stel Interne Processen op

Compliance is geen eenmalig project, maar een continu proces.

Wat moet je doen? Integreer AI Act-checks in je bestaande processen. Bij de inkoop van nieuwe software, voeg een "AI Act risico-check" toe. In je ontwikkelcyclus, maak "documentatie" en "bias-check" vaste onderdelen.

Praktische tip: Wijs een duidelijke eigenaar aan. Dit kan een 'AI Compliance Officer' zijn, of een rol die wordt vervuld door je Data Protection Officer (DPO) of CISO. Gedeelde verantwoordelijkheid is vaak geen verantwoordelijkheid.

Stap 6: Monitor en Rapporteer

Voor hoog-risico systemen is monitoring na de lancering (post-market monitoring) verplicht.

Wat moet je doen? Verzamel actief data over de prestaties van je AI-systeem in de praktijk. Werkt het zoals bedoeld? Treden er onverwachte problemen op? Ernstige incidenten moeten binnen 15 dagen worden gerapporteerd aan de toezichthouder.

Speciale Aandacht voor MKB en Startups

De EU begrijpt dat een startup geen multinational is. Daarom zijn er specifieke ondersteuningsmaatregelen om de lasten voor het MKB te verlichten:

AI Regulatory Sandboxes: Vanaf augustus 2026 moeten alle lidstaten (ook Nederland) een ‘proeftuin’ hebben. Hier kunnen MKB'ers met voorrang en vaak gratis hun innovatieve AI-systemen testen in een gecontroleerde omgeving, onder begeleiding van de toezichthouder. Dit is een enorme kans om te innoveren zonder direct de volledige compliance-last te dragen.

Vereenvoudigde Documentatie: Er komen templates en vereenvoudigde procedures voor de technische documentatie, speciaal voor kleinere bedrijven.

Lagere Kosten: Boetes en kosten voor conformiteitsbeoordelingen worden proportioneel toegepast op basis van de bedrijfsgrootte.

De boodschap: Wees niet geïntimideerd door de regels. Er zijn hulplijnen en kortere routes speciaal voor jou.

Tijdlijn & Boetes: De Harde Realiteit

Wachten is geen optie. Dit is de tijdlijn die je in je agenda moet zetten:

Februari 2025: Verbod op onaanvaardbare AI-systemen treedt in werking. De plicht voor AI-geletterdheid start.

Augustus 2025: Regels voor General-Purpose AI (GPAI) modellen worden van kracht.

Augustus 2026: Alle vereisten voor hoog-risico systemen worden volledig van kracht. Vanaf nu kunnen de hoge boetes worden uitgedeeld.

Augustus 2027: Einde van de overgangsperiode voor specifieke, reeds gereguleerde producten met AI-componenten.

En de boetes? Die zijn vergelijkbaar met de AVG en niet mals:

€35 miljoen of 7% van de wereldwijde jaaromzet voor het gebruik van verboden AI.

€15 miljoen of 3% van de omzet voor het niet naleven van de meeste andere verplichtingen (incl. hoog-risico).

€7,5 miljoen of 1% van de omzet voor het verstrekken van onjuiste informatie.

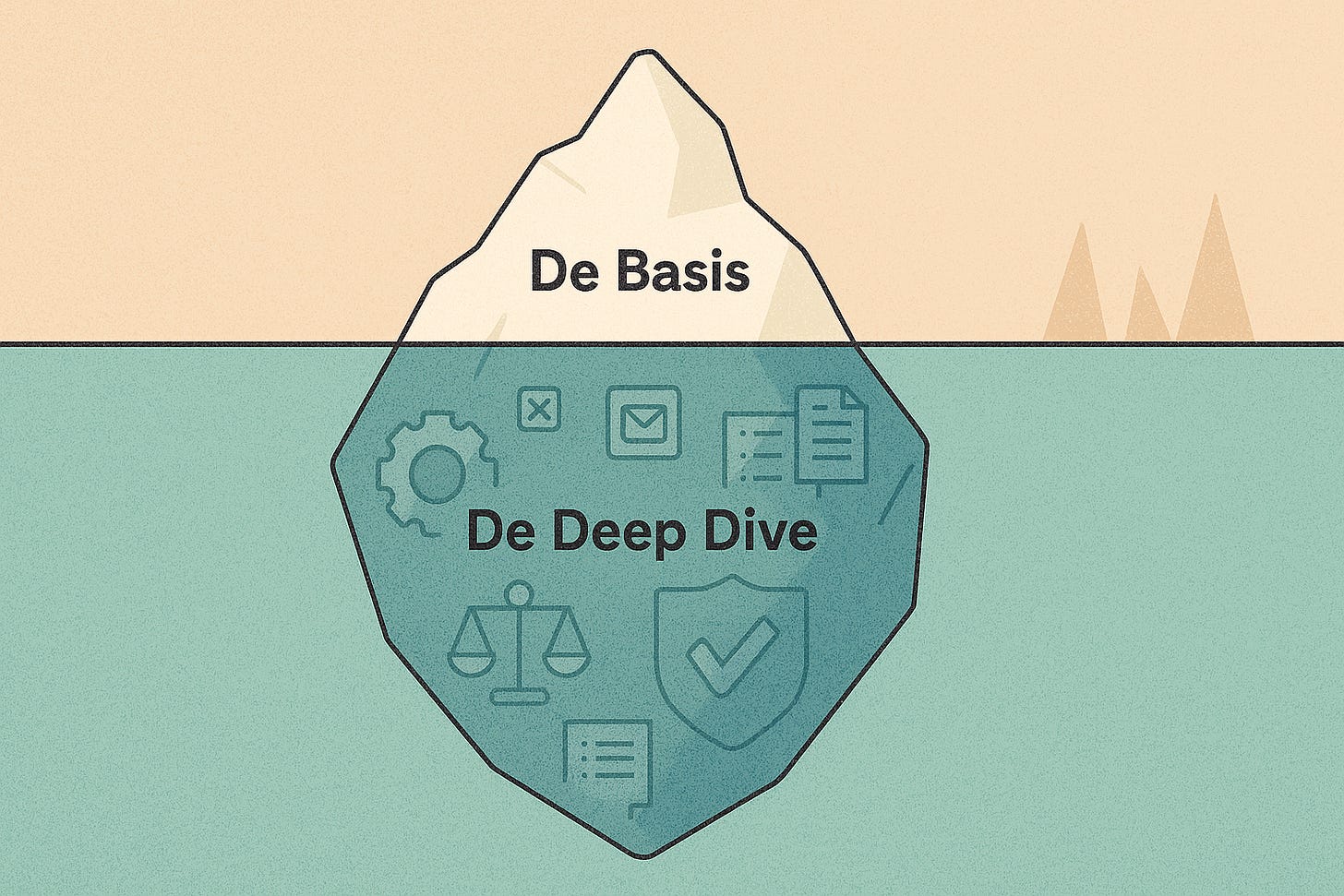

Klaar voor de volgende stap?

Je hebt nu de essentiële kennis om de AI Act te begrijpen en de eerste stappen te zetten. Maar de echte uitdaging zit in de details. Hoe voer je een gedegen risicoanalyse uit? Welke tools gebruik je voor post-market monitoring? En hoe stel je waterdichte contracten op met je AI-leveranciers?

In het volledige playbook duiken we dieper in:

De Provider vs. Deployer Checklist: Een gedetailleerde checklist met de specifieke verplichtingen voor zowel ontwikkelaars als gebruikers van hoog-risico AI.

Template voor je AI-Register: Een direct bruikbare spreadsheet om je inventarisatie en classificatie te managen.

Het Fundamental Rights Impact Assessment (FRIA) Framework: Een stapsgewijze handleiding voor het uitvoeren van de verplichte impactanalyse voor de publieke sector en andere deployers.

Contractuele Clausules voor AI-Inkoop: Voorbeeldclausules die je kunt opnemen in je contracten met leveranciers om AI Act-compliance af te dwingen.

Gids voor de Nederlandse AI Sandbox: Hoe, wanneer en waarom je je moet aanmelden voor de Nederlandse proeftuin om je innovatie te versnellen.

AI-Geletterdheid Actieplan: Een concreet plan om een effectief en gedocumenteerd trainingsprogramma op te zetten voor je team, inclusief aanbevolen content en tools.