Google’s nieuwe AI leert realtime bij | OpenAI slokt 40% van de chipvoorraad op

Google's realtime AI-model en de strijd om AI-chips: wat dit betekent voor Nederlandse startups en AI-marketing.

De meeste AI-modellen die je vandaag gebruikt, zijn eigenlijk een briljante encyclopedie die twee jaar geleden voor het laatst is bijgewerkt. Ze leren niets van de gesprekken die ze vandaag voeren. Ze vergeten alles zodra het gesprek afloopt.

Google presenteert nu een architectuur die dit verandert. Hun Titans-model leert tijdens het gebruik en beslist zelf wat het onthoudt op basis van hoe verrassend nieuwe informatie is. We verschuiven hiermee van AI die ‘alles weet van vroeger’ naar AI die ‘begrijpt wat er nu gebeurt’.

In deze editie:

Hoe Google’s Titans-architectuur AI een werkend geheugen geeft en waarom dat je IT-architectuur drastisch versimpelt

Waarom OpenAI 40% van de wereldwijde geheugenproductie opkoopt en wat dat betekent voor jouw hardwarekosten in 2026

De data die niemand wil zien: GenAI-advertenties presteren 19% beter dan menselijk werk (maar alleen als je er niet over praat)

Waarom Amsterdamse startup Orq.ai €5 miljoen ophaalt om de ‘Mollie voor AI’ te worden

Google’s ‘Titans’: Het einde van statische AI-modellen?

Je kent het probleem waarschijnlijk wel: je praat met een AI, laten we zeggen een chatbot of een analyse-tool, maar eigenlijk praat je met een encyclopedie die twee jaar geleden voor het laatst is bijgewerkt. Tenzij je dure, complexe koppelingen bouwt, leert het model niets van de gesprekken die het vandaag voert. Het is briljant, maar lijdt aan acuut geheugenverlies.

Google lijkt daar nu een fundamentele oplossing voor te hebben gevonden.

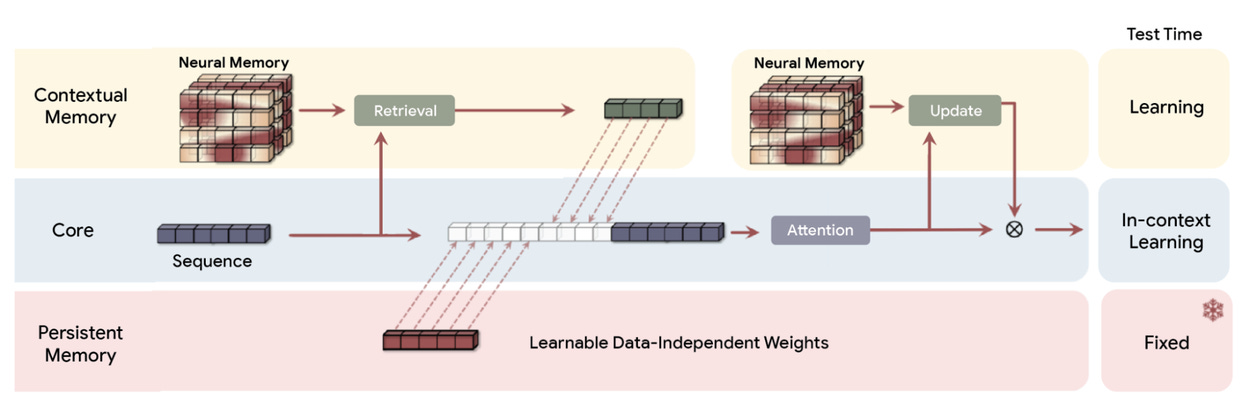

In een opvallend nieuwe publicatie onthullen onderzoekers van Google de Titans-architectuur en het MIRAS-framework. Laat de technische namen even voor wat ze zijn; waar het om gaat is dat deze technologie breekt met de status quo van ‘statische’ AI.

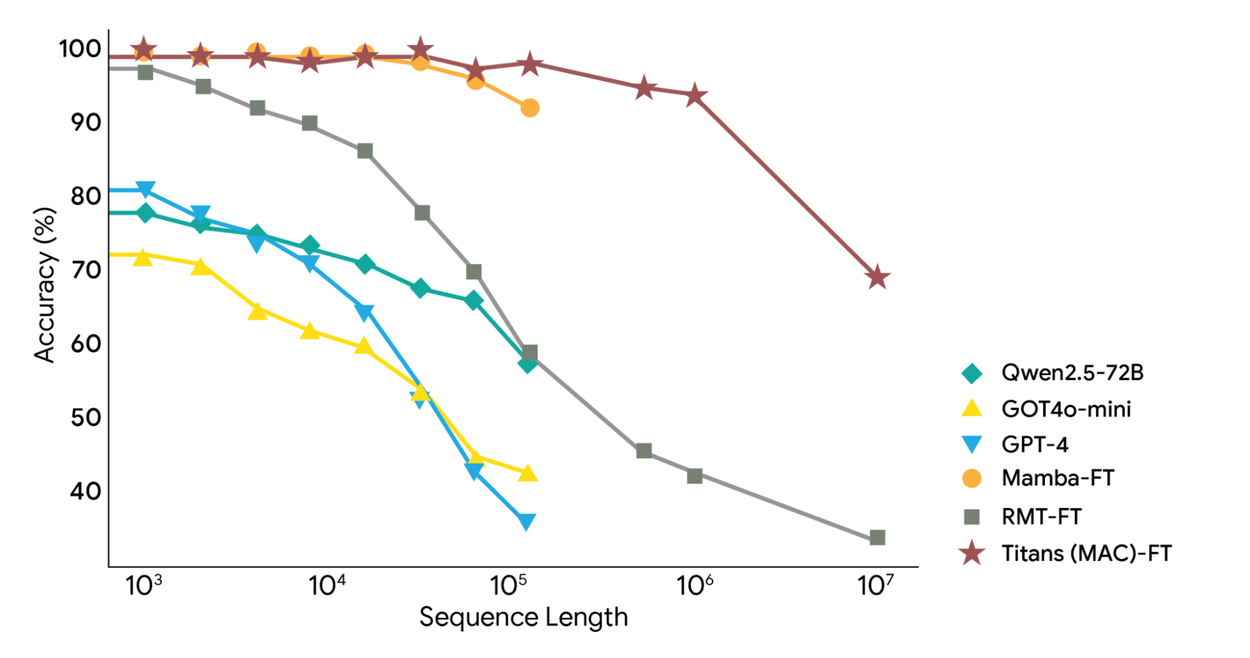

De meeste huidige modellen (zoals de Transformers achter ChatGPT) zijn na hun training ‘af’. Alles wat ze daarna moeten weten, moet je ze telkens opnieuw voeren via de prompt. Dat kost rekenkracht en vertraagt de boel naarmate de teksten langer worden.

Titans werkt anders. Het model bezit een vorm van langetermijngeheugen dat functioneert als een diep neuraal netwerk. Het leert tijdens het gebruik.

Wat dit concept fascinerend maakt, is hoe menselijk de onderliggende logica is. De onderzoekers introduceren een zogenaamde ‘surprise metric’. Het model beslist zelf wat het onthoudt op basis van hoe onverwacht de informatie is. Routinezaken worden vergeten, maar verrassende nieuwe data wordt direct opgeslagen in de ‘core memory’. Hierdoor kan het model contexten van meer dan 2 miljoen tokens (denk aan duizenden pagina’s tekst) verwerken zonder trager te worden.

Voor de Nederlandse markt en ondernemers brengt dit een aantal interessante verschuivingen met zich mee:

Hyper-gepersonaliseerde klantervaring: Een klantenservice-bot hoeft niet meer bij elk contact in een CRM te graven om te weten wie jij bent. Het model ‘herinnert’ zich eerdere interacties en voorkeuren organisch, net zoals een menselijke collega dat zou doen.

Goedkopere verwerking van massadata: Omdat Titans lineair schaalt (in plaats van kwadratisch zoals oudere modellen), wordt het analyseren van enorme juridische dossiers, codebases of technische handleidingen drastisch goedkoper en sneller.

Minder ‘Lijm-Software’: Veel bedrijven bouwen nu ingewikkelde systemen om data uit hun databases in de AI te proppen (RAG). Als het model zelf beter onthoudt, wordt je IT-architectuur een stuk slanker.

Toch moeten we hier ook de advocaat van de duivel spelen. Er schuilt namelijk een risico in deze aanpak.

Als een AI-model ‘live’ leert van input, wie controleert dan de kwaliteit van die lessen? Stel je voor dat kwaadwillenden,of gewoon onwetende gebruikers, het model voeden met onjuiste informatie die vervolgens wordt opgeslagen in het langetermijngeheugen. Dit fenomeen, ‘data poisoning’, is bij statische modellen al een risico, maar bij modellen die real-time leren wordt het beveiligen van wat het model ‘gelooft’ een compleet nieuwe uitdaging.

De vraag is niet alleen of het werkt, maar hoe je voorkomt dat je AI de verkeerde dingen leert en deze als feiten gaat presenteren aan je volgende klant.

We bewegen hiermee van AI die ‘alles weet van vroeger’ naar AI die ‘begrijpt wat er nu gebeurt’. Voor bedrijven betekent dit dat de focus verschuift van het trainen van modellen naar het bewaken van de datastroom tijdens het gebruik.

AI is creatiever dan jij (volgens de data)

We houden onszelf graag voor dat creativiteit het laatste bastion van de mens is. We accepteren dat computers sneller kunnen rekenen, maar ‘emotie’ en ‘ziel’? Dat blijft mensenwerk. Nou, dat romantische beeld kan, met de harde cijfers van vandaag, direct de prullenbak in.

Een nieuw, uitgebreid onderzoek gepubliceerd op SSRN legt een pijnlijke realiteit bloot voor de creatieve sector. Wat blijkt? Advertenties die volledig door GenAI zijn ontworpen, presteren aanzienlijk beter dan het werk van menselijke experts. En met beter bedoelen we niet een procentje hier of daar.

We praten over een stijging van maar liefst 19% in doorklikratio’s (CTR) in echte verkoopomgevingen.

Het fascinerende aan dit onderzoek zit hem in de nuance. De onderzoekers vergeleken drie scenario’s:

Advertenties gemaakt door menselijke experts.

Advertenties waarbij mensen het voortouw namen en AI gebruikten voor aanpassingen (de ‘hybride’ aanpak).

Advertenties die volledig door GenAI werden gegenereerd.

Je zou verwachten dat de combinatie van menselijk inzicht en machinale snelheid wint. Maar nee. De hybride advertenties presteerden nauwelijks beter dan de menselijke benchmark. Het was de volledige AI-aanpak die de winst pakte.

De analyse toont aan dat volledig door AI gegenereerde beelden ‘vloeiender’ zijn voor ons brein om te verwerken. Ze roepen sterker, directer emoties op. Wanneer mensen zich ermee bemoeien om een beeld aan te passen, introduceren we onbedoeld creatieve beperkingen die de impact verzwakken. De machine snapt blijkbaar beter wat ons onderbewuste wil zien dan wijzelf.

Voor ondernemers en marketingteams is dit een belangrijk signaal. We zitten vaak vast in het idee dat we AI moeten gebruiken als een ‘assistent’ die onze schetsen inkleurt. Dit onderzoek suggereert het tegenovergestelde: laat de AI het zware creatieve werk doen, van concept tot eindproduct. Dit effect wordt zelfs nog sterker als GenAI ook de productverpakking mag ontwerpen.

Het succes van deze AI-advertenties hangt volledig af van één factor: onwetendheid. Zodra consumenten weten dat de advertentie door AI is gemaakt, stort de effectiviteit in elkaar. De doorklikratio daalt dan met maar liefst 31,5%.

Dit creëert een pervers dilemma voor bedrijven. De technologie werkt fantastisch, zolang je er maar over zwijgt. Nu regelgevers wereldwijd steeds strengere eisen stellen aan het labelen van AI-content, stevenen we af op een harde botsing tussen commercieel succes en transparantie.

In de praktijk betekent dit dat marketeers moeten kiezen: ga je voor de 19% prestatiewinst en neem je het reputatierisico, of ben je transparant en accepteer je een lagere conversie? De middenweg, AI gebruiken om een beetje bij te schaven, lijkt in elk geval de slechtste optie van allemaal.

De hardware-squeeze: Waarom je laptop straks duurder is door OpenAI

Een van de meest bekende namen in computergeheugen, Crucial, wordt de nek omgedraaid. Moederbedrijf Micron heeft besloten te stoppen met het verkopen van geheugenkaarten en SSD’s aan consumenten. Niet omdat ze failliet gaan, integendeel. Ze stoppen ermee omdat ze hun fabriekscapaciteit simpelweg niet meer willen ‘verspillen’ aan consumenten.

De echte marge zit namelijk elders.

De tech-industrie is in een brute strijd om grondstoffen beland, en dat heeft directe gevolgen voor iedereen die wel eens hardware aanschaft. Micron zet nu alles op alles om de grote AI-spelers te bedienen. En als je ziet wat er achter de schermen gebeurt, begrijp je waarom.

Volgens opvallende rapporten uit de industrie heeft OpenAI op 1 oktober jongstleden in het diepste geheim deals gesloten die de markt volledig op zijn kop zetten. Sam Altman zou in één klap beslag hebben gelegd op maar liefst 40% van de wereldwijde DRAM-productie (het geheugen dat cruciaal is voor chips) door gelijktijdig contracten te tekenen met Samsung en SK Hynix.

Wat dit verhaal extra pikant maakt, is de agressiviteit waarmee dit gebeurt. OpenAI koopt naar verluidt geen kant-en-klare chips, maar hamstert de ruwe ‘wafers’ – de onbewerkte basisplaten. Ze halen de grondstoffen uit de markt voordat er überhaupt een product van gemaakt kan worden. Het effect is een klassieke squeeze: er is simpelweg te weinig over voor de rest.

De situatie is inmiddels zo absurd dat Samsung Semiconductor weigert geheugen te verkopen aan hun eigen broertje, Samsung Mobile. De chipdivisie verkoopt liever aan datacenters die de hoofdprijs betalen, dan aan hun eigen collega’s die smartphones moeten bouwen. Als zelfs Samsung intern ruzie maakt over tekorten, weet je dat de marktkoorts een kookpunt heeft bereikt.

Voor Nederlandse ondernemers en professionals betekent dit concreet drie dingen:

De hardware-prijzen gaan exploderen. Of het nu gaat om nieuwe laptops voor je personeel of servers op locatie: de prijzen voor alles met geheugen (en dat is bijna alles) gaan de komende maanden en waarschijnlijk heel 2026 flink omhoog. SSD’s en RAM-modules worden schaars en duur.

Cloudkosten stijgen mee. Denk niet dat je veilig zit in de cloud. Azure en AWS moeten deze duurdere hardware ook inkopen. Reken erop dat deze kosten vroeg of laat worden doorberekend in je maandelijkse abonnementen.

Levertijden lopen uit. Waar je gewend was ‘vandaag besteld, morgen in huis’, gaan we terug naar levertijden van weken of maanden voor specifieke zakelijke hardware.

Wat OpenAI doet, lijkt naar paniekvoetbal. Het oppotten van onbewerkte wafers zonder dat er direct productiecapaciteit is om ze te verwerken, creëert een kunstmatige schaarste. Het doet denken aan het hamsteren van wc-papier tijdens de pandemie, maar dan met miljarden dollars inzet. De vraag is niet alleen of dit ethisch is, maar vooral of dit op lange termijn houdbaar is. Als de ‘AI-bubbel’ ook maar een klein beetje lucht verliest, zit OpenAI op een berg ongebruikt silicium terwijl de rest van de markt onnodig is uitgehongerd.

Hardware is voorlopig geen sluitpost meer op de begroting, maar een strategisch risico. Heb je binnenkort een IT-refresh gepland voor je bedrijf? Wacht niet af tot de prijzen dalen, want die bodem is voorlopig niet in zicht. Nu investeren is pijnlijk, maar over zes maanden waarschijnlijk een koopje.

De ‘Mollie voor AI’ haalt miljoenen op: waarom je eigen infrastructuur bouwen nu verleden tijd is

Iedereen in de tech-wereld kent het fenomeen: je ziet een AI-demo die je mond doet openvallen, maar zodra je het probeert te integreren in een echt product, begint de ellende. Het model hallucineert, de kosten lopen uit de klauwen en de compliance-afdeling trapt op de rem.

Het verschil tussen een leuke demo en een werkend product is vaak een moeras van technische complexiteit. Precies in dat gat springt de Amsterdamse startup Orq.ai.

Het bedrijf van oprichters Anthony Diaz en Sohrab Hosseini heeft zojuist 5 miljoen euro opgehaald om dit probleem voor eens en altijd op te lossen. Hun belofte is even simpel als ambitieus: ze willen de ‘Mollie voor AI’ worden.

De vergelijking is niet toevallig gekozen. Waar Mollie het betalingsverkeer demystificeerde voor webshops, wil Orq.ai de wirwar van LLM-integraties, prompts en governance stroomlijnen voor bedrijven.

Het is makkelijk om zo’n claim af te doen als de zoveelste marketingkreet, maar de namen achter deze investering dwingen respect af. Niemand minder dan Adriaan Mol (oprichter van Mollie) is aan boord als strategisch adviseur. Dat is een duidelijk signaal: de mensen die weten hoe je complexe infrastructuur versimpelt, geloven in deze aanpak.

Orq.ai stelt dat teams die hun platform gebruiken tot 67% sneller leveren. Klanten zoals AFAS, MoneyBird en Helloprint gebruiken het al om grip te krijgen op hun AI-modellen. In plaats van dat developers kostbare tijd verliezen aan het bouwen van eigen ‘schakelkasten’ tussen verschillende AI-modellen, pluggen ze in op een bestaand systeem dat ook direct de regels en veiligheid bewaakt.

Het klinkt ideaal, maar er schuilt een risico in deze ‘middleware’-aanpak. Door een tussenlaag als Orq.ai te gebruiken, maak je je bedrijf strategisch afhankelijk van nog een externe partij. Je besteedt in feite de intelligentie-infrastructuur van je product uit.

Als Orq.ai zijn prijzen verhoogt of de stekker eruit trekt, heb je een probleem in het hart van je applicatie. Daarnaast is het de vraag hoe lang het duurt voordat cloud-giganten als Microsoft Azure of AWS soortgelijke features standaard in hun pakket opnemen, waardoor dit soort tools overbodig kunnen worden.

Ondanks de risico’s is de boodschap voor Nederlandse ondernemers helder: de tijd van zelf houtje-touwtje oplossingen bouwen voor AI-integraties is voorbij.

Als je nu nog je eigen backend aan het schrijven bent om simpelweg tussen GPT-5 en andere modellen te schakelen, verbrand je waarschijnlijk geld en tijd die je beter aan je product kunt besteden. De markt professionaliseert in rap tempo; zorg dat je technische fundering dat ook doet.

The Shortlist

Meta sluit meerjarige deals met grote uitgevers zoals Reuters en CNN om Meta AI te voeden met real-time nieuws, een strategische zet om de betrouwbaarheid van zijn assistent te vergroten.

AWS introduceert tijdens re:Invent de autonome ontwikkelaar ‘Kiro’, die dagenlang zelfstandig complexe codeer-taken kan uitvoeren, en onthult de krachtige Trainium3-chip voor efficiëntere AI-training.

Science Corp claimt een doorbraak met het ‘Prima’-implantaat dat zicht herstelt bij blinde patiënten, waarmee oprichter Max Hodak (ex-Neuralink) de volgende stap zet in brain-computer interfaces.

Wat kun jij deze materie helder verwoorden. Maar doe mij toch maar het spreekwoordelijke pen en papier 😊